Введение

Устройства хранения информации на жестких дисках традиционно устанавливались главным образом на настольных компьютерах, однако в последнее время накопители все чаще находят применение и в бытовой электронике. В настоящей статье описываются способы оценки надежности накопителей, установленных в настольных компьютерах и бытовых электронных устройствах, с использованием результатов стандартных лабораторных испытаний компании Seagate.

Определения

Под наработкой на отказ Seagate подразумевает отношение времени РОН (Power-On Hours — время в часах, в течение которого накопитель находился во включенном состоянии) в течение года к усредненной интенсивности отказов AFR (Annualized Failure Rate — годовая интенсивность отказов) за первый год. Такой метод дает достаточную точность при малом количестве отказов, поэтому мы используем его для расчета наработки на отказ «первого года». Усредненная годовая интенсивность отказов для накопителя рассчитывается на основе данных о времени безотказной работы, полученных в ходе испытаний RDT (Reliability-Demonstration Test — демонстрационные испытания надежности). По той же методике проводятся и заводские испытания FRDT (Factory Reliability-Demonstration Test — заводские демонстрационные испытания надежности), однако здесь проверяются серийные накопители из производственных серий. В рамках настоящего документа мы будем исходить из того, что любая концепция, применимая в отношении RDT, справедлива также и для FRDT.

Испытания на надежность, проводимые Seagate

В Группе персональных устройств хранения Seagate со штаб-квартирой в г. Лонгмонт (шт. Колорадо) испытания накопителей для настольных систем на надежность обычно проводятся в термокамерах при температуре окружающей среды +42 градуса по Цельсию, что повышает интенсивность отказов. Кроме того, накопители при этом эксплуатируются с максимально возможной продолжительностью включения (под продолжительностью включения дисковода понимается количество поисков данных, их считывания и записи в течение заданного отрезка времени). Это делается для того, чтобы выявить как можно больше причин отказа еще на стадии разработки изделия. Устранив проблемы, отмеченные на этом этапе, мы можем быть уверены, что наши пользователи с ними больше не столкнутся.

Оценка параметров по Weibull

Предположим, что испытанию RDT были подвергнуты 500 накопителей, каждый из которых проработал 672 часа при температуре окружающей среды 42°С. Допустим также, что в ходе испытания было отмечено три отказа (после 12, 133 и 232 часов работы). Это означает, что из 500 проверенных накопителей успешно прошли испытание 497. Для анализа и экстраполяции полученных результатов мы применяем моделирование по Weibull, используя для этого пакет программ SuperSmith фирмы Fulton Findings1. В частности, с помощью метода максимального правдоподобия производится оценка таких параметров распределения Weibull, как бета (форм-фактор) и эта (масштабный коэффициент).

(То есть априори предполагается, что отказы распределены согласно Weibull. Для тех, кто знаком с математической статистикой, приведу формулу плотности вероятности для этого распределения:

Смысл проводимых испытаний — оценить параметры распределения. При этом считается, что при заданном значении бета параметр эта равен времени в часах, за которое выйдут из строя 90% тестируемых накопителей. (Обсуждение данной математической модели требует серьезных познаний в математической статистике и выходит за рамки данной статьи, поэтому предлагается принять ее как факт) — прим. редактора).

Если в ходе испытания отмечено пять или менее отказов, точно определить параметр бета по полученным данным невозможно. Поскольку такие результаты испытаний встречаются довольно часто, мы анализируем их с помощью метода WeiBayes2, в основу которого положена оценка параметра бета по статистическим данным. В лаборатории продукции для настольных компьютеров мы сейчас принимаем бета = 0,55. Такое значение получено на основе производственных данных, представленных ниже в таблице. Она составлена на основании испытания всех накопителей для настольных систем, прошедших проверку до марта 1999 г.

| Место производства накопителей | База данных | Среднее значение бета | Стандартное отклонение бета |

|---|---|---|---|

| Лонгмонт | 37 RDT, 5 FRDT | 0,546 | 0,176 |

| Пераи | 2 RDT, 4 FRDT | 0,617 | 0,068 |

| Вузи | 1 RDT | 0,388 | нет данных |

| Обобщенные данные по настольным системам | 49 испытаний | 0,552 | 0,167 |

Приведенный ниже график отображает результаты анализа Weibull и WeiBayes. Сплошная линия соответствует параметрам бета и эта по Weibull (бета = 0,443, эта = 69 331 860), рассчитанным по методу MLE (Maximum Likelihood — максимальное правдоподобие)3 всего для 3 отказов на 500 накопителей. Как уже отмечалось, такие результаты считаются не столь точными, как полученные по методу WeiBayes для небольшой интенсивности отказов.

Результаты, полученные методом WeiBayes (для бета = 0,55), представлены на графике пунктирной линией. Поскольку 672 часа работы при температуре 42°С для испытания RDT вполне достаточно, мы использовали свой внутренний параметр «доверительная вероятность прекращения испытаний»4, который для анализа WeiBayes принят равным 63,2%. Расчет по методу WeiBayes показал, что при температуре 42°С и статистическом значении бета = 0,55 приемлемое значение эта составляет 3 787 073 часа.

Легенда к графику «Примеры анализа по методам Weibull и WeiBayes»

W/mle = Доверительная вероятность прекращения испытаний

WeiBayes fit = Аппроксимация WeiBayes

Observed Weibull fit via MLE = Аппроксимация данных исследования по Weibull методом максимального правдоподобия

Eta = эта

Beta = бета

n/s = (всего/исправных накопителей)

Следующий этап анализа состоит в пересчете параметра эта, полученного в результате тестов при 42°С, в значение, соответствующее нашей стандартной рабочей температуре (25°С). Опираясь на модель Arrhenius5, для учета температурных различий можно принять коэффициент учащения отказов равным 2,2208. Таким образом, значение эта для 25°С (эта25) будет равным значению этого параметра для 42°С (эта42), умноженному на 2,2208, то есть, 8 410 332 часа.

Оценка среднего времени наработки на отказ в течение первого года на основании параметров Weibull

На основании параметров бета и эта Weibull, полученных после температурной коррекции, в любой момент можно рассчитать суммарный процент отказов. Чтобы оценить процент накопителей, которые могут выйти из строя при температуре 25°С в промежутке времени от t1 до t2, достаточно произвести вычитание значений суммарного процента отказа в моменты t1 и t2, а затем воспользоваться соответствующими значениями бета и эта25.

Для оценки усредненной интенсивности отказов (параметр AFR) за первый год эксплуатации накопителя, установленного в настольном компьютере, примем, что у пользователя устройство находится во включенном состоянии 2 400 часов в год. Допустим также, что еще 24 часа оно эксплуатировалось на заводе на этапе интеграции. Поскольку все накопители, вышедшие из строя в течение этого периода, возвращаются в Seagate и к конечному пользователю не попадают, при расчете AFR и наработки на отказ за первый год они не учитываются.

С учетом приведенного выше (продолжительность включения 100%, эта25 = 8 410 332 час, бета = 0,55 и общее время работы за год 2 400 час) относительную интенсивность отказов за первый год можно рассчитать как интенсивность отказов, произошедших в период между 24 час (t1) и 2 424 час (t2). Результаты такого расчета приведены ниже в таблице, построенной на основе наработки на отказ в течение первого года и данных, полученных в ходе испытаний RDT.

| Исходные данные: 2 400 час/год | |

|---|---|

| Форм-фактор по Weibull (бета): | 0,55 |

| Масштабный коэффициент по Weibull (эта): | 8 410 332 |

| Р(отказов) от 0 до 2 400 час/год: | 1,123% |

| Р(отказов) от 0 до 24 час: | 0,089% |

| ————— | |

| AFR за первый год | 1,0338% (до округления) |

| Наработка за год: | 2 400 час |

| AFR за первый год: | 0,010338 |

| ————— | |

| Наработка на отказ за первый год по Weibull: | 232 140 час |

(Р(отказов) вычисляются на основании распределения Weibull — см. график. Далее понятно: Наработка на отказ за первый год = Наработка за год / AFR за первый год — прим. редактора).

Учет реальных условий использования

Как показывают приведенные выше расчеты, если накопитель используется при температуре 25°С и находится во включенном состоянии 2 400 часов в год, можно ожидать, что при работе у пользователя средняя наработка на отказ составит 232 140 часов. Однако такие условия соблюдаются в бытовой электронике не всегда. В некоторых бытовых приборах, скажем, накопитель может работать почти непрерывно, поэтому время его работы за год намного превысит 2 400 часов. В других же устройствах, например, игровых видеоприставках, этот показатель может оказаться значительно ниже. В последующих разделах описано, как именно можно скорректировать расчетное значение наработки на отказ для различной интенсивности использования, продолжительности включения и окружающей температуры.

Интенсивность использования

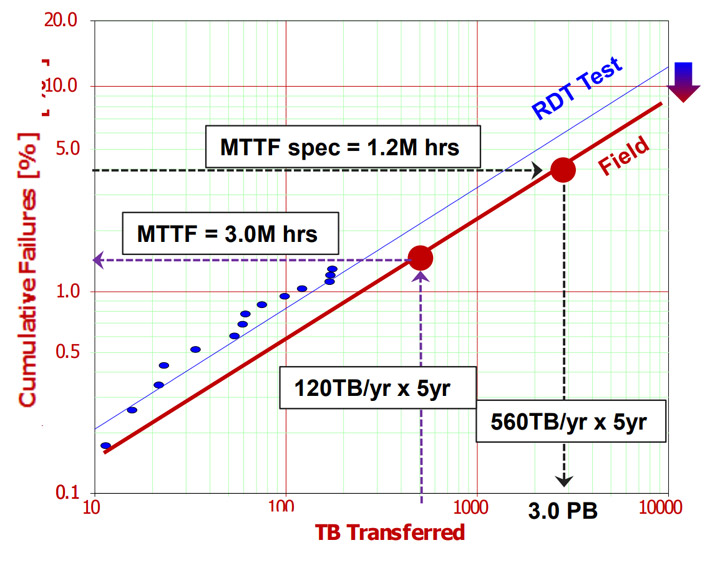

Учесть изменения средней наработки на отказ, вызванные различиями в интенсивности использования накопителя, можно с помощью приведенного графика.

Легенда к графику «Коррекция среднего времени наработки на отказ в зависимости от ожидаемого времени работы накопителя за год»

Название вертикальной оси — Корректирующий множитель для наработки на отказ

Название горизонтальной оси — Ожидаемое время работы накопителя за год

Например, если известна наработка на отказ для 2 400 рабочих часов в год, а реальное рабочее время за год составляет 8 760 часов, то среднее время наработки на отказ снизится примерно вдвое. И наоборот: когда накопитель работает мало, как это бывает в некоторых игровых видеоприставках, то наработка на отказ может почти удвоиться.

Температура

Теперь давайте посмотрим, как изменяется время наработки на отказ при повышении рабочей температуры. Для построения графика температурного коэффициента времени наработки на отказ можно применить ту же модель Arrhenius, которую мы использовали для определения коэффициента учащения отказов. Представленная ниже таблица показывает, как снижается наработка на отказ за первый год (если продолжительность включения составляет 100%) при температуре окружающей среды выше 25°С.

| Температура, °С | Коэффициент учащения отказов | Температурный коэффициент снижения времени наработки на отказ | Скорректи- рованное время наработки на отказ |

|---|---|---|---|

| 25 | 1,0000 | 1,00 | 232 140 |

| 26 | 1,0507 | 0,95 | 220 533 |

| 30 | 1,2763 | 0,78 | 181 069 |

| 34 | 1,5425 | 0,65 | 150 891 |

| 38 | 1,8552 | 0,54 | 125 356 |

| 42 | 2,2208 | 0,45 | 104 463 |

| 46 | 2,6465 | 0,38 | 88 123 |

| 50 | 3,1401 | 0,32 | 74 284 |

| 54 | 3,7103 | 0,27 | 62 678 |

| 58 | 4,3664 | 0,23 | 53 392 |

| 62 | 5,1186 | 0,20 | 46 428 |

| 66 | 5,9779 | 0,17 | 39 464 |

| 70 | 6,9562 | 0,14 | 32 500 |

Как видно из таблицы, по мере роста окружающей температуры температурный коэффициент снижения времени наработки на отказ и скорректированная наработка на отказ значительно сокращаются. Так, при 42°С коэффициент учащения отказов составляет 2,2208 (как и было определено в ходе настоящего анализа ранее). А коэффициент коррекции времени наработки на отказ для этой же температуры равен 0,45, то есть среднее время наработки на отказ при температуре 42°С оказывается в два с лишним раза меньше, чем при температуре 25°С.

Продолжительность включения

Продолжительность включения большинства накопителей, установленных в персональных компьютерах, составляет от 20 до 30%, тогда как в бытовых электронных устройствах этот показатель может быть выше или ниже. Измерив объем данных, который пересылается внутри современных устройств бытовой электроники за сутки, специалисты Seagate установили, что продолжительность включения накопителей в них составляет всего 2,5%.

Чтобы определить, как изменяется наработка на отказ при продолжительности включения 2,5% по сравнению со 100% (такое значение характерно для испытаний RDT), нужно выяснить, какое влияние на этот процесс оказывают те компоненты накопителей, состояние которых зависит от продолжительности включения, а какое — другие его элементы. Количество зависимых компонентов в накопителе прямо пропорционально количеству пластин жестких дисков в нем. Взаимоотношение между числом жестких дисков и усредненной интенсивности отказов за первый год отображено на следующей иллюстрации. Пространство под пунктирной линией на этом графике соответствует «базовой», — то есть, не зависящей от того, как долго работает устройство, — интенсивности отказов гипотетического накопителя с нулевым количеством жестких дисков (или накопителя, который не производит чтения, записи и поиска информации). Сплошной линией отмечена ожидаемая интенсивность отказов как функция количества жестких дисков.

Легенда к графику «Зависимость общей и базовой усредненной интенсивности отказов от количества жестких дисков в накопителе»

Название вертикальной оси — Нормализованное значение AFR

Название горизонтальной оси — Количество пластин жестких дисков (не более 4)

Total AFR = Общая усредненная интенсивность отказов

Base AFR = Базовая усредненная интенсивность отказов

Как видно из графика, уменьшение продолжительности включения снижает количество только тех отказов, которые связаны со временем работы накопителя (пространство между пунктирной и сплошной линиями). Зная соотношение между количеством отказов, зависящих от продолжительности включения, и их общим числом, можно оценить влияние продолжительности включения на усредненную интенсивность отказов AFR. Так, для накопителя с четырьмя жесткими дисками общая интенсивность отказов составит 1,4%, а базовая — 0,6%. Снижение продолжительности включения уменьшит вероятность отказа на [(1,4 — 0,6)/1,4] = 57%. Таким образом, снижая время работы четырехдискового накопителя, мы можем уменьшить вероятность отказа только на 57%, остальная доля неполадок от продолжительности включения не зависит.

Изменение коэффициента наработки на отказ для накопителей с разным количеством жестких дисков представлено на следующем графике.

Легенда к графику «Зависимость коэффициента наработки на отказ от продолжительности включения накопителя и количества жестких дисков в нем»

Название вертикальной оси — Коэффициент наработки на отказ

Название горизонтальной оси — Продолжительность включения

1-disk… = Для дисковода минимальной емкости с 1 жестким диском

2-disk… = Для дисковода с 2 жесткими дисками

3-disk… = Для дисковода с 3 жесткими дисками

4-disk… = Для дисковода максимальной емкости с 4 жесткими дисками

Комплексный учет нескольких факторов

Продолжая анализ, оценим комбинированное воздействие различных значений продолжительности включения и температурных коэффициентов сокращения наработки на отказ для нескольких накопителей. На графике внизу слева представлены коэффициенты коррекции наработки на отказ для накопителя высокой емкости с 4 жесткими дисками при разных комбинациях продолжительности включения и температуры окружающей среды. Рисунок справа отображает такие же коэффициенты для накопителя, оснащенного только одним жестким диском. Как видно из этих графиков, в зависимости от продолжительности включения и рабочей температуры накопителя, установленного в ПК, эффективная наработка на отказ за первый год может оказаться выше, равной или ниже, чем ожидаемое значение этого параметра, рассчитанное по результатам заводских испытаний. При этом на накопителе с одним жестким диском изменение продолжительности включения и окружающей температуры сказывается слабее, а коэффициенты коррекции здесь значительно меньше.

Легенда к графикам «Снижение времени наработки на отказ в зависимости от температуры и продолжительности включения (для накопителя максимальной емкости с 4 жесткими дисками/минимальной емкости с 1 жестким диском)»

Название вертикальной оси — Коэффициент снижения времени наработка на отказ

Название горизонтальной оси — Окружающая температура, °С

DF@100%… = Продолжительность включения = 100%

DF@30%… = Продолжительность включения = 30%

DF@20%… = Продолжительность включения = 20%

DF@10%… = Продолжительность включения = 10%

DF@5%… = Продолжительность включения = 5%

DF@1%… = Продолжительность включения = 1%

Надежность после первого года эксплуатации

Согласно распределению Weibull, описывающему зависимость наработки на отказ от срока эксплуатации, при значении бета меньше единицы вероятность отказов оборудования со временем снижается. По этой причине интенсивность отказов накопителей на первом году эксплуатации должна быть выше, чем в последующие годы. Но какова будет интенсивность отказов или среднее время наработки на отказ, если усреднить эти показатели за все время эксплуатации накопителя? Ниже приведены три метода оценки надежности, позволяющие ответить на этот вопрос.

- Можно с помощью анализа Weibull (бета, эта25) оценить количество возможных отказов после первого года эксплуатации. Однако для этого потребовалось бы получить дополнительные данные демонстрационных испытаний надежности, увеличив длительность самих испытаний на порядок или больше. Такой подход едва ли можно признать целесообразным.

- Можно использовать информацию о гарантийном обслуживании из базы данных Seagate. Она позволит оценить соотношение накопителей, возвращенных на втором и третьем году эксплуатации, и устройств, в которых возникли сбои в течение первого года. Однако такие данные имеются только за первые три года эксплуатации — именно на этот срок распространяется действие большинства гарантийных обязательств Seagate на накопители для настольных компьютеров. Правда, серьезным преимуществом этого подхода является то, что все данные относятся исключительно к продукции Seagate для настольных систем.

- Можно принять так называемую «плоскую» модель, предполагающую, что после завершения первого года эксплуатации интенсивность отказов остается на постоянном уровне. Это означает, что во все годы после первого интенсивность отказов будет такой же, как и на втором году эксплуатации. Поскольку вероятность отказа со временем уменьшается, данный метод дает осторожную оценку средней наработки на отказ для всего срока эксплуатации.

Сравнение всех трех моделей приведено в таблице ниже.

| МОДЕЛЬ: | |||||||

|---|---|---|---|---|---|---|---|

| Weibull | По данным гарантийного обслуживания (только по OEM) | »Плоская» модель | |||||

| Год эксплу- атации | Суммарная продолжи- тельность включения (час) | Интен- сив- ность отказов за год | Суммар- ная интенсив- ность отказов | Интен- сив- ность отказов за год | Суммар- ная интенсив- ность отказов | Интен- сив- ность отказов за год | Суммар- ная интенсив- ность отказов |

| 1 | 2 400 | 1,20% | 1,20% | 1,20% | 1,20% | 1,20% | 1,20% |

| 2 | 4 800 | 0,55% | 1,75% | 0,78% | 1,98% | 0,55% | 1,75% |

| 3 | 7 200 | 0,43% | 2,18% | 0,39% | 2,37% | 0,55% | 2,30% |

| 4 | 9 600 | 0,37% | 2,55% | 0,55% | 2,86% | ||

| 5 | 12 000 | 0,33% | 2,88% | 0,55% | 3,41% | ||

| 6 | 14 400 | 0,30% | 3,18% | 0,55% | 3,96% | ||

| 7 | 16 800 | 0,28% | 3,46% | 0,55% | 4,51% | ||

| 8 | 19 200 | 0,26% | 3,72% | 0,55% | 5,06% | ||

| 9 | 21 600 | 0,24% | 3,96% | 0,55% | 5,62% | ||

| 10 | 24 000 | 0,23% | 4,19% | 0,55% | 6,17% |

Чтобы нагляднее продемонстрировать различия между моделями, мы приводим график суммарной относительной интенсивности отказов, построенный на основании каждой из них (время наработка на отказ для первого года эксплуатации принято равным 200 000 часов).

Легенда к графику «Суммарная годовая интенсивность отказов, рассчитанная по Weibull и «плоской» модели, в сравнении с данными гарантийного обслуживания»

Название вертикальной оси (между цифрами точки заменить на запятые) — Суммарная интенсивность отказов за год эксплуатации пользователем

Название горизонтальной оси — Год эксплуатации пользователем

Weibull analysis = Анализ по Weibull

«Flatline» model = «Плоская» модель

Model based… = Модель оценки по данным гарантийного обслуживания

Как видно из приведенного выше графика, «плоская» модель дает более осторожную оценку, чем «чистый» анализ по Weibull, и очень близка к оценке по данным гарантийного обслуживания Seagate за первые три года. Для простоты анализа, а также для того, чтобы получить более осторожные оценки, мы решили применять в своих расчетах «плоскую» модель.

При использовании «плоской» модели суммарные результаты отношения между наработкой на отказ за все время эксплуатации к этому параметру за первый год могут выглядеть следующим образом:

| Средние значения за первые три года: | |

|---|---|

| Отказов в год: | 0,768% |

| Наработка на отказ: | 312 500 час |

| Прирост по сравнению с некорректированным значением наработки на отказ (232 140 час): | 1,56 |

| Средние значения за первые пять лет: | |

| Отказов в год: | 0,682% |

| Наработка на отказ: | 352 113 час |

| Прирост по сравнению с некорректированным значением наработки на отказ (232 140 час): | 1,76 |

| Средние значения за первые десять лет: | |

| Отказов в год: | 0,617% |

| Наработка на отказ: | 389 105 час |

| Прирост по сравнению с некорректированным значением наработки на отказ (232 140 час): | 1,95 |

Проведенные расчеты показывают, что для оценки среднего времени наработки на отказ за три года эксплуатации дисковода нужно умножить исходный показатель за первый год (для той же продолжительности включения и окружающей температуры) на коэффициент 1,56. Аналогично можно рассчитать и среднее время наработки на отказ за пять и десять лет, умножив значение исходного параметра за первый год на 1,76 и 1,95 соответственно.

Окончательный расчет

На основе всех коэффициентов, рассчитанных выше, мы можем преобразовать наработку на отказ, указываемую фирмой Seagate (на первый год эксплуатации, при 2 400 рабочих часах в год и продолжительности включения 100%) в среднее время наработки на отказ для накопителя, установленного в устройстве конечного пользователя и работающего при конкретной окружающей температуре с определенной продолжительностью включения. После этого можно также оценить и среднее время наработки на отказ за все время службы накопителя.

Ниже приведен пример расчета среднего времени наработки на отказ в течение первого года и всего срока эксплуатации для накопителя, работающего в течение 2 400 часов в год при температуре 34°С, продолжительности включения 30% и рассчитанного на срок службы 5 лет.

| Наработка на отказ за первый год: | 232 140 час | (на основе параметров бета и эта25 по Weibull) |

| х 0,90 | (температурный коэффициент для 38°С и продолжительности включения 30%) | |

| Наработка на отказ за первый год в устройстве пользователя: | 208 926 час | |

| Наработка на отказ в устройстве пользователя: | 208 926 час | |

| х 1,76 | (коэффициент усреднения за пятилетний период) | |

| Наработка на отказ за весь срок эксплуатации в устройстве пользователя: | 367 710 час |

В качестве завершающего примера рассмотрим накопитель Seagate с одним жестким диском, для которого наработка на отказ в течение первого года составляет 444 000 час. Допустим, он установлен в бытовом электронном устройстве, используется 2 920 часов в год (8 часов в день, 7 дней в неделю) при окружающей температуре 42°С и продолжительности включения 5%.

| Наработка на отказ за первый год: | 444 000 час | (на основе параметров бета и эта25 по Weibull) |

| х 0,92 | (коррекция для 2 920 час/год) | |

| х 0,59 | (температурный коэффициент для 42°С и продолжительности включения 5%) | |

| х 1,95 | (коэффициент усреднения за 10-летний период) | |

| Наработка на отказ в устройстве пользователя в течение первого года: | 469 956 час |

Заключение

Описанный выше метод позволяет использовать данные лабораторных испытаний Seagate для оценки надежности накопителей, установленных в настольных компьютерах и бытовых электронных приборах, которые работают в условиях «реального мира». Вкратце этот метод сводится к следующему:

- С помощью анализа Weibull или статистических данных испытаний RDT/FRDT оцените параметры Weibull для лабораторных условий.

- Используя методику WeiBayes, проанализируйте данные испытаний для конкретного типа накопителя; определите значения усредненной интенсивности отказов AFR за первый год и наработку на отказ при проведении испытаний RDT.

- Откорректируйте полученные результаты с учетом отличия лабораторных условий RDT от реальной температуры и продолжительности включения, при которых будет работать накопителей, установленный в аппаратуре конечного пользователя.

- Исходя из осторожного предположения, что после первого года эксплуатации интенсивность отказов останется постоянной, пролонгируйте оценку надежности за первый год на трех- и десятилетний срок службы накопителя.

В заключение отметим, что данный метод позволяет математически обоснованно применять результаты лабораторных испытаний Seagate для оценки надежности накопителей, установленных в бытовых электронных приборах.

Примечания:

1 SuperSmith, Fulton Findings, WinSMITH и WinSMITH Weibull являются зарегистрированными товарными знаками фирмы Fulton Findings (1251 W. Sepulveda Blvd., #800, Torrance, CA 90502, США).

2 Abernethy, Dr. Robert B., The New Weibull handbook, Second Edition, авторское издание, 1996, глава 5.

3 Abernethy, Dr. Robert B., The New Weibull handbook, Second Edition, авторское издание, 1996, приложение D.

4 Чтобы компенсировать неопределенность оценки параметров по Weibull из-за ограниченности времени работы дисководов, можно повысить доверительный уровень при проведении испытаний RDT.

5 Nelson, Wayne, Applied Life Data Analysis, John Wiley & Sons, 1982.

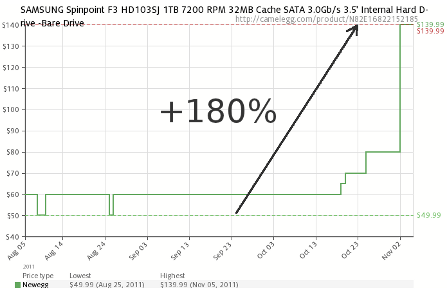

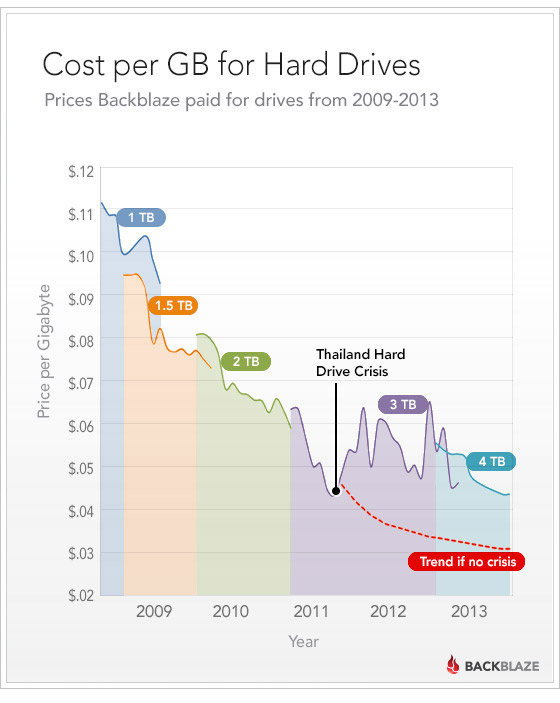

В прошлый раз мы рассмотрели этапы борьбы за господство в «дисковой» подсистеме твердотельных накопителей и традиционных жестких дисков. Там же мы коротко осветили нюансы ресурса твердотельных накопителей. Сегодня мы попытаемся рассмотреть вопрос практической надежности дисков жестких. Казалось бы, несколько запоздало, но не будем забывать, что ближайшие не менее чем 10–20 (а скорее всего и гораздо больше — об этом мы еще поговорим) лет этот вид продуктов будет гарантированно доступен на рынке в массовом сегменте по причине наличия немаленьких ниш, где скоростные достижения твердотельных накопителей избыточны, а хранимые данные относительно холодны. Да и перспективные объемы жестких дисков в ближайшее время твердотельным накопителям по адекватным ценам не догнать.

Теоретизировать на этот счет можно, конечно, долго. Можно вспоминать явно неудачные решения производителей, например, с чересчур частой парковкой головок или особо громкие изделия, но основной критерий в вопросе констатирования, как мне кажется, должен быть статистически-прикладным, особенно на фоне того, что в отличие от ситуации с SSD, найти утвержденные современные стандарты выносливости для классических винтов вряд ли получится.

Вопросы классификации

Напомним, что внешне и физически современные актуальные жесткие диски бывают по форм-фактору в основном 2,5″ и 3,5″. Исполнение бывает как внутренним, так и внешним.

Внутри мобильных внешнеподключаемых накопителей лежат обычные 2,5-дюймовые жесткие диски, которые в большинстве случаев можно достать и подключить к ноутбуку или десктопу напрямую, если те обладают нужными интерфейсами. И наоборот — можно положить в такой карман подходящие по толщине имеющиеся диски, сделав их мобильными и внешнеподключаемыми.

В случае с 2,5 дюймами встречается толщина 12,5, 9,5, 7 и даже 5 мм. Электрически они будут совместимы, но физические размеры, как понимаем, будут отличаться. Выглядит вот так:

Контактные группы одинаковы, но толщина разная. 2,5-дюймовые варианты жестких дисков чаще используются в портативной технике. Чем тоньше ноутбук, тем более внимательно надо смотреть, какой толщины накопитель предусмотрел туда изготовитель. Тонкие диски в места для толстых поставить не проблема — они часто продаются с утолщителями в виде пластиковой рамки, чтобы не болтались в посадочных местах для более толстых коллег. В отсутствии рамки проложить их можно чем угодно — хоть картоном по углам. А вот более толстые затолкать в места для худых не выйдет — будьте внимательны!

Были и 1,8- и 1,3- и даже 1-дюймовые Microdrive в формате Сompact flash II — вообще левшовые практически изделия. Но это уже история, т.к. в ультракомпактном сегменте всех разогнал привычный флэш.

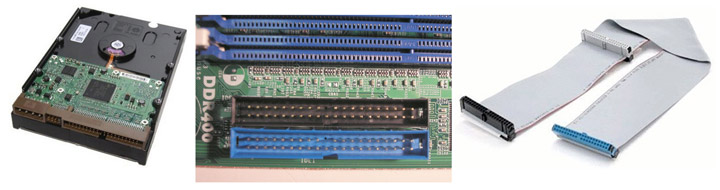

Типы интерфейсов

Интерфейсы сегодня в быту бывают SATA и все еще IDE, в профессиональном использовании есть и SAS. В вопросы параллельности и последовательности, а также понятия шин в рамках этого материала погружаться не будем.

IDE, он же АТА, они же аббревиатуры от Integrated Drive Electronics и Advanced Technology Attachment, растет корнями из 90-х и уже уходит в прошлое. Новых массовых материнских плат с ним не делают уже лет 10 наверно, но в наличном парке его еще полно. Пропускает 133 мегабайт в секунду и выглядит разъемом конкретно вот так на накопителе. Крайнее слева — питание, справа — данные. И соответственно на материнской плате. Подключается плоским шлейфом обычно серого или черного цвета. Вот таким.

Рассмотрели мы это чисто для исторической справки.

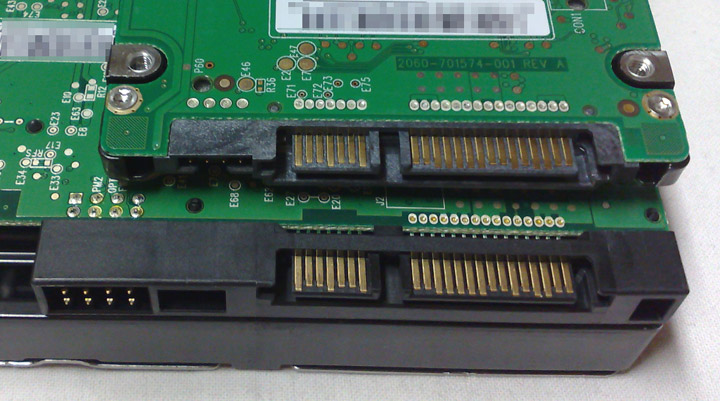

Мейнстримом же сегодня является SATA. Типично для 2,5- и 3,5-дюймовых решений выглядит вот так:

Справа контактная группа питания, слева — данных. Вид: накопители вверх дном. Между собой совместимо. Подключается как на картинке.

Ревизии и пропускные способности мы рассмотрели в прошлый раз и здесь останавливаться не будем. Отметим только, что есть разновидности типа eSATA для внешних устройств и slimline SATA для компактных внутренних. И да — SATA заточен под горячую замену, т.е. на ходу без перезагрузки. Разве что в диспетчере устройств может понадобиться нажать кнопку «обновить» в случае Windows.

Существуют переходники для питания и возможностей подключить IDE в SATA и наоборот, но мы не об этом.

SAS это Serial Attached SCSI и используется в основном в профессиональной сфере, обратно совместим с SATA и имеет пропускную способность 12–24 Гбит в секунду. Выглядит похоже на SATA, но разъемом отличается. Обороты большие — до 15000, коррекция ошибок, multipath — как «в лучших домах Парижу и ЛондОну», но дорого и в быту не воткнуть. А еще греется так, что на некоторые модели радиаторы килограммовые нужны.

Но вернемся к вопросу.

Проблемы технологий

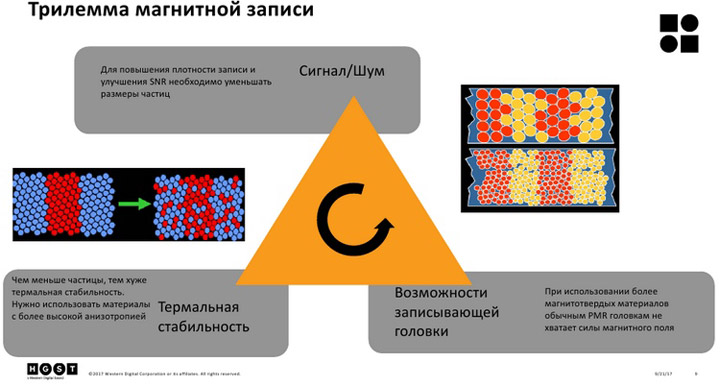

Сегодняшние массовые жесткие диски находятся на излете традиционных технологических возможностей. Плотность данных на одну рабочую пластину можно увеличить только принципиально новыми технологиями, а толщину самого «блина» уменьшать для дальнейшего увеличения их числа в сборке все сложнее. Кроме того, поднимать обороты шпинделя к многотысячным высотам в теории конечно можно, но за этим должны будут успеть остальные участники забега и при этом не упираться в воздух, который в ряде линеек уже меняется на гелий. Увеличивать количество блоков головок, вспоминая прошлое, тоже неслабая инженерная задача, учитывая все изложенное. Да и пост-SCSI в виде SAS в SOHO приземлять никто не спешит, правда это дорого и по факту почти устарело морально. Но не в этом направлении, похоже, пойдет индустрия.

Если коротко, то совокупность проблем развития жестких дисков изложена в тройке взаимоисключающих параграфов, которая вполне научно называется трилеммой. Суть примерно такова — для увеличения плотности записи нужно уменьшать записываемые области на носителе и соответственно размеры головок вкупе с материалами, из которых все изготавливается, но при этом ухудшаются как магнитные свойства таких миниатюрных областей, так и возможности маленькой головки, в том числе по их стабильному разборчивому чтению. Чтобы решить последнее надо увеличивать первое, а общая задача изначально требует как раз обратного. Т.е. кольцевая.

Но НИОКР не стояли на месте и их результаты сконцентрировались вокруг вполне конкретных и реализуемых предложений для достижения поставленной задачи увеличения объемов жестких дисков. Часть из них еще в разработке, а что уже и рынку показывали. Основной тренд — полировка магнитных технологий подходами локального нагрева в процессе записи и создание инфраструктуры для системы в целом, с учетом новых вводных. Но среди оставшихся производителей традиционных «винтов» единства в видении перспектив нет. Т.е. направление в целом одно, а вот пути достижения вроде бы похожих целей — технически отличаются.

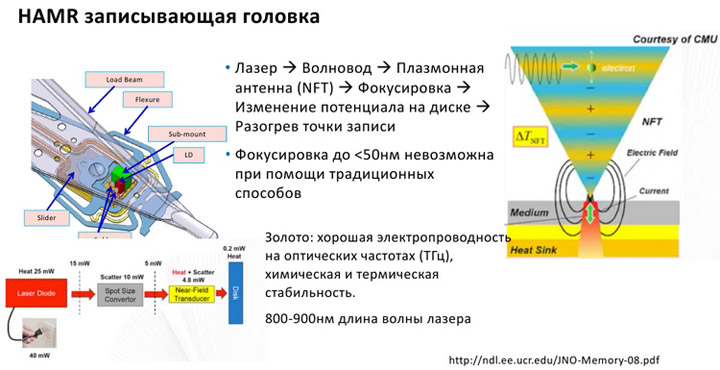

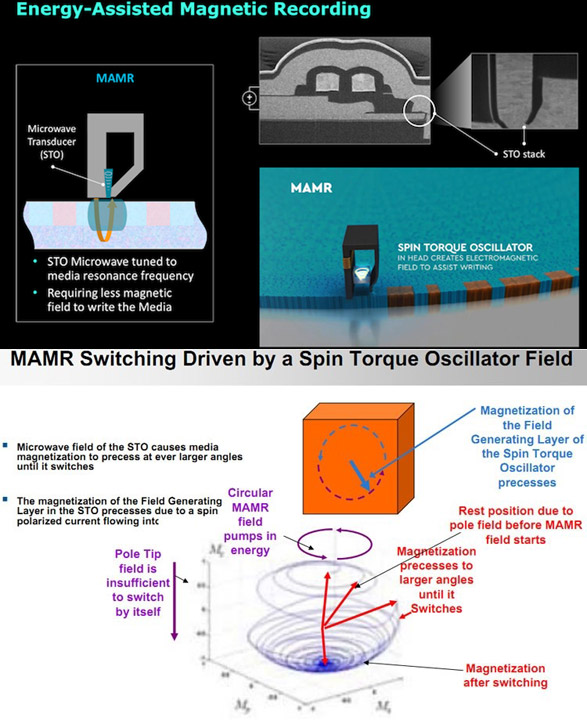

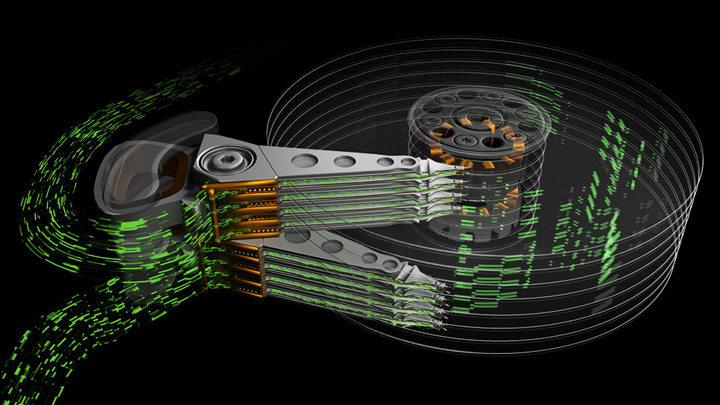

Термомагнитная схватка трех ёкодзун

В ближайшем будущем мы, вероятнее всего, увидим для решения трилеммы магнитной записи соединения следующих подходов. Тон будут задавать, несомненно, термомагнитные концепции. Основных сегодня известно две. Это HAMR — Heat-Assisted Magnetic Recording — запись с, в прямом смысле, подогревом! А мы помним, что по чисто физическим причинам в случае наличия подогрева намагничивать для записи бита можно меньшую площадь и делать это с меньшими энергозатратами, т.е. одновременно с достижением нужной плотности и головке легче работать и ее саму проще делать в части подбора материалов и электромагнитных характеристик. Продвигается Seagate. Тематическое видео производителя не песня, но посмотреть можно.

Второй подход называется MAMR — Microwave Assisted Magnetic Recording — тоже про нагрев, но иным способом, спинтронным, прости Господи, осциллятором на базе ну очень маленького аналога того, что массам понятно как микроволновая печка. Поддерживается WD и Toshiba. Видео куда более информативное и его можно глянуть по ссылке.

Оба подхода, как видим, по сути, про нагрев, но разными способами и второй способ совместим с гелием, а первый — не очень, т.к. сильно греть гелиевую герметичную среду лазером или подобным, это как варить сгущенку в закрытой банке. Может, конечно, какие-то принципиально новые лазерные технологии подвезут в перспективе, но пока это так.

Масленица

Следующим системным элементом эволюции HDD будут «блины потоньше». Здесь, конечно, все и так предельно тонко, но уменьшая толщину отдельного блина в типичный корпус их можно поместить больше. Даже +1 блин — это существенное увеличение общей емкости, а на фоне еще и увеличения плотности — так вообще хорошо. Один из главных черенков этого рынка Showa Denko K.K. из Японии предлагает пластины, способные нести около 2 терабайт на штуку в случае 3,5-дюймового типоразмера накопителя. Восемь блинов в сборке — реальность вчерашнего дня, в лабораториях прототипы на 12! Немцы гарантируют.

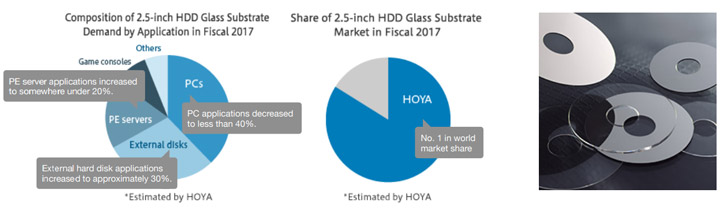

Почему прозрачные? Так блины бывают на основе алюминия и стекла.

Стекло пожестче и не менее главный черенок, но уже, в том числе, медицинского рынка — Hoya из той же Японии — уже пиарит предложения стеклянных вариантов толщиной аж до 0,38 мм! Обе иллюстрации выше — их творчество. Причем тут они? Они с оптикой хорошо работают, а под жестко-стеклянные блины для винчестеров целый дополнительный завод в Лаосе к Вьетнамскому и Таиландскому построят. Гарантирует уже Xinhua. К слову — почти весь рынок «стекла» для 2,5″ жестких дисков — за Hoya.

HELIUM

Гелий (но не вакуум, хотя и такие смельчаки есть! — в паспортах на жесткие диски максимальные высоты работы указывают именно по этой причине) станет мейнстримом, хотя и существует с 2012 года. Он менее плотный, чем воздух или азот, и в его среде сборке на высоких оборотах крутиться легче. Ну и головкам проще быстрее перемещаться. О гелии и вакууме мы еще поговорим.

Горячие головы

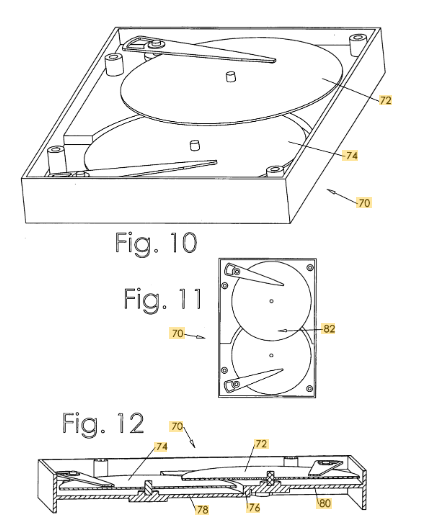

Головки, как проистекает из вышеизложенного и будет подтверждено ниже, будут инновационнее, меньше и их, возможно, станет больше, как у Conner Peripherals «Chinook».

Современное видение многоголовочности от Seagate выглядит примерно так (даже анимация есть):

Если картинка от Seagate основана на реальных планах и прошивки таких дисков смогут распределять данные на сборки пластин, которые работают с физически независимыми блоками головок, то фактически мы получим спарку дисков в одном корпусе с RAID 0 подобной логикой работы. В итоге скорости могут возрасти пропорционально количеству блоков головок, т.е., в данном случае, вдвое: что линейные, что 4К-блоками. Правда скорости работы с 4К на уровне 1–2 мегабайт никого не спасут, зато линейные будут вполне себе ничего для технологии и достаточные для своих ниш.

Уголок футуролога

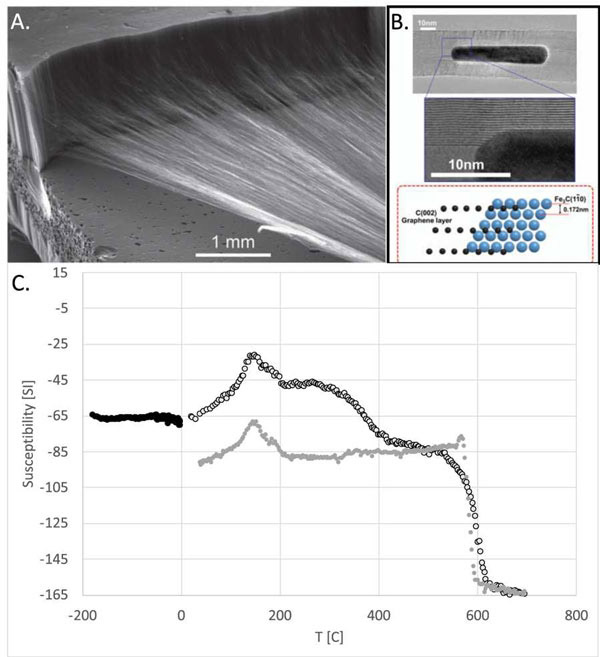

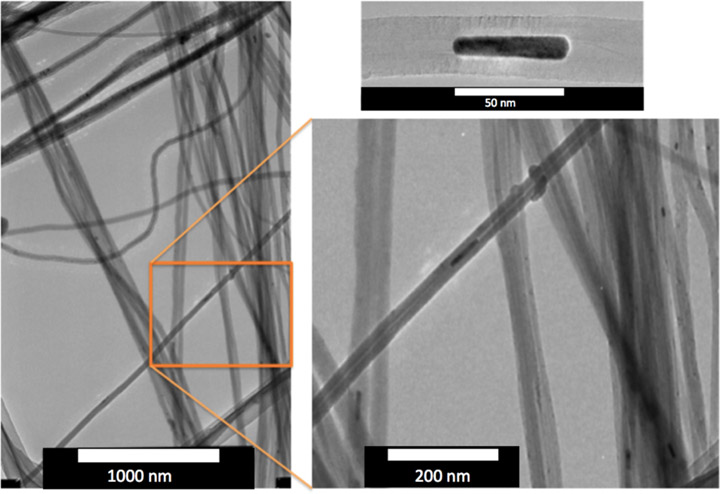

Отдельные футурологи, правда, предсказывают возможность имплементировать в жесткие диски технологии магнитного туннелирования на базе содержащих наномагнитные вкрапления углеродных нанотрубок. Почитать можно по ссылке. Выглядит как-то вот так:

Ничего непонятно, но очень интересно (с). Особенно непонятно как это внедрять на практике.

А кто-то пишет про накопители на голографических технологиях и даже технологиях ДНК! Но это пока все в отдаленной перспективе даже у научников, не говоря уже о реальных образцах.

RPM

С оборотами вопрос открыт т.к. эта часть механики жесткого диска обуславливает требования к остальному тандему и способностям интерфейсов. 15 000 об/мин освоены, но насколько можно взять бОльшую высоту со стабильными результатами — пока непонятно. Тут важно понимать, что малейший дисбаланс сборки на 15000+ оборотах кончит мотор очень быстро. С другой стороны, в силу физики, скорость потока данных на внутренних и внешних частях блина при одинаковых оборотах шпинделя будет хорошо так разной. Еще неплохо бы понимать — а выдержит ли тонкий стеклянный блин или сборка из восьми таких пластин на высоких оборотах вибрацию вообще без разрушения? И это мы еще не коснулись привода головок, которому тоже неплохо бы не отставать. В общем, тут комплексная задача, как сказано, для всего тандема и обороты в ней стоят на последнем месте.

Страничка изобретательства и рационализации

Тандема… хорошее слово. Об этом даже патент от 2004 года есть. Туда бы еще диагональных блоков независимых головок, блины намазать нанотрубками, гелий, черепицу, совместимый калорифер и будет полный стимпанк. Правда с надежностью что будет — подумать страшно.

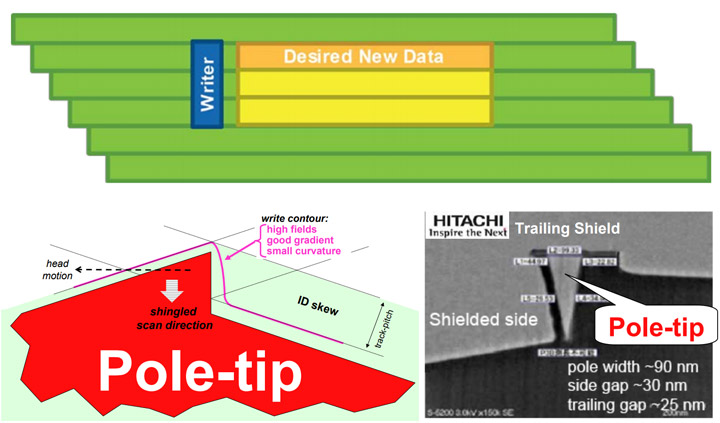

Черепица = SMR

Тут самое время вспомнить про черепичную запись — технология давно в тираже, но там есть нюансы, которые не позволяют внедрять это дома. В англоязычных источниках эта дискотека известна как SMR (Shingled Magnetic Recording). Суть примерно следующая — на пластину стандартного типового физического размера записать поплотнее как можно больше дорожек. Причем тут черепица? А дорожки предлагается чтобы они частично перекрывались. Естественно, чтобы писать тонкие, как sin в армейском анекдоте про комара, дорожки надо иметь соответствующую по размеру головку, а перед этим еще технологии ее таковой сделать с нужными магнитными характеристиками. Но вот совсем микроскопические головки индивидуально делать тяжело, зато записать сразу несколько дорожек — можно. Условно соотношение обычной традиционной дорожки на пластине жесткого диска и дорожки в случае технологии черепичной записи можно визуализировать так (здесь и далее используем инфографику, любезно опубликованную, Microsemi):

Синим — пишущая головка и традиционная дорожка, зеленым — ширина ридера инновационных дорожек. Почему нарисована одна дорожка — смотрим ниже т.к. это же одновременно и ключевой косяк затеи.

Вот так условно выглядит записанное. Именно условно, т.к. на практике там начинается почти черная магия для рядового потребителя, и мы тешимся самоуспокоением, что, типа, знаем как оно устроено. Привет вам, мистер Кларк.

В общем, головка вспахивает, т.е. намагничивает сразу несколько дорожек. И вроде все достаточно понятно, но все равно имеется проблема. В силу физических особенностей технологии эту прелесть удобно использовать только для последовательной записи т.к…. перезаписать дорожки выборочно и поштучно, внезапно, нельзя. Точнее можно, но для случайной записи там будет серьезное усложнение процедуры, с которым разберемся внимательней. Т.е. в принципе можно, но ходом — нельзя.

Итак, записанное в несколько дорожек головка SMR диска и сотрет аналогично — т.е. коллективно, т.к. записывающая головка — она же стирающая. Такой себе комбайн с широким столом.

Выглядит вот так и по версии когда-то еще Hitachi — ниже.

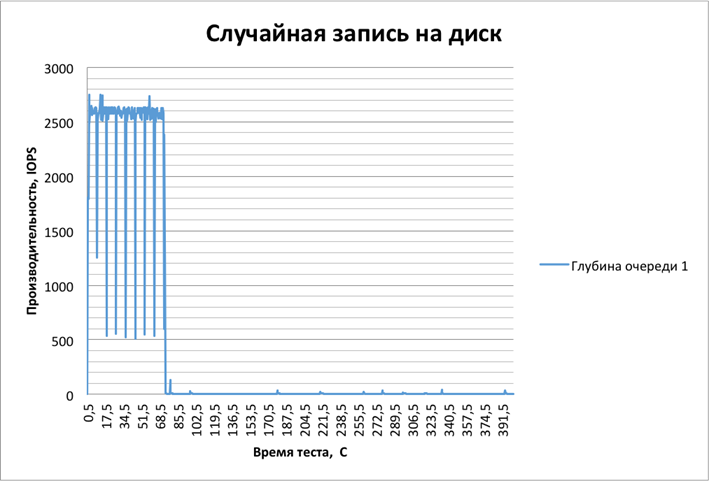

Т.е. чтобы записать оранжевый фрагмент надо физически перезаписать дорожки в ширину пишущей головки в обязательном порядке. Чтобы выполнить задачу надо считать фрагмент, где-то на уровне какого-нибудь DRAM буфера разложить его на нужное и ненужное. Присовокупить к нужному новый участок данных. Собрать до кучи и отослать через головку на место для кучной записи. Будет хорошо, если новый фрагмент в целом виде меньше стираемого. Если нет, то дописывать придется фрагментарно (что вызовет проблемы, о которых ниже) или в идеале в место после физического конца данных на таком диске. Чисто в теории контроллер может поискать, где там есть свободные места, но в реальности это вызовет системный паралич. Конечно, МСМК по комбинаторике сейчас не понимают в чем проблема. Но ее с математической точки зрения и не будет — логически это все несложно. А вот провернуть затею на конкретном электро-механическом уровне займет физическое время и расчетные ресурсы плюс возможные издержки на коррекцию ошибок. Т.е. на случайной записи «вертерство» будет еще похлеще обычного HDD. Seagate произвел тестирование накопителя Archive 8TB на SATA3 на Debian. Результат случайной записи выглядит примерно так:

Леденящий душу пик провала до лютых 3! (именно три, 1+1+1 шт.) IOPS мы видим после исчерпания буферов на нагрузке случайной записи с глубиной очереди 1, правда, более чем через минуту, что несколько снижает уровень драматизма, но и верхние пики объективно не фонтан.

Если же просто стирать случайные данные (считали, убрали ненужное, записали назад нужный остаток), то получаются проплешины, которые для нормальной записи в будущем надо обрабатывать и уплотнять процессом, похожим на дефрагментацию и фоново. Это очень похоже на TRIM в SSD — и там и тут надо подготовить поле для прямой записи в возможную ширину без дополнительных телодвижений в процессе, но в силу механической природы жёсткого диска быстро это сделать не получится, да и общая нагрузка сильно возрастет — такой себе аналог усиления записи. В идеале вообще все уплотнить так, чтобы писать новое в физический конец имеющегося, но это связано с физической же обработкой больших массивов данных со всеми вытекающими. Состояние диска, когда новая запись идет в чистое пространство вообще или в чистое подготовленное после уплотнения и сбора мусора пространство, иногда называют FOB — fresh out of box или новый из коробки — и это, по сути, идеальные условия для такого рода записи. Просматривается некоторая аналогия с SSD.

Картина требовала обработки напильником и именно поэтому таким дискам добавили для транзитно-буферных целей обычные области, работающие по принципу одной дорожки на всю ширину головки. Т.е. обычная технология традиционных накопителей. По логической сути это аналог SLC-кэширования в твердотельных накопителях TLC и QLC, только в нашем варианте там может храниться еще и служебная информация о том, что и где удалено и прочее. Для еще более действенного решения вопроса и DRAM-буферизацию подвезли. Добавили математики в прошивку и стало более-менее — т.е. пока буфер превышает типичное среднее задание, тормозов системой особо не ощущается, диск не «боттлнечит». Именно это и видно на иллюстрации вверху. В том случае накопитель мог иметь аж 256 мегабайт буфера, но конкретная протестированная модификация, к сожалению, указана не была. Общая характеристика «железки» по ссылке и думается, что производитель тестировал все же максимальную конфигурацию.

Естественно есть и иные ухищрения для решения описанных проблем, логический зонинг, ленточная организация и тому подобное, вплоть до модифицированных прошивок под конкретные задачи! Но в силу основной их проблемы — физической первопричины, такие подходы лишь сглаживают углы.

Все указанное недвусмысленно намекает, что, несмотря на взрослые объемы хранения SMR-накопителей, они, ввиду технологии, являются нишевыми для конкретных типов нагрузок, но в этих нишах они выступают как раз целевым образом. Например — линейная многопоточная запись-чтение без или с минимумом случайных операций. Хорошим вариантом будет дата-центр, ориентированный на чтение не сильно горячих данных. К слову, если на массиве таких дисков будет размещена база какой-нибудь социальной сети, то догадайтесь с 3 раз, будет ли кто-то реально удалять из массива случайные, скажем, фотографии, если пользователь нажмет «удалить» в профиле? Или такие фото просто перестанут отображаться пользователям, но физически останутся в массиве доступными администрации на фоне перспектив падения производительности от связанных с этим дискодвижений? Проще подвезти полуторку дополнительных дисков, чем тормозить массив случайными операциями с последующим уплотнением данных. Выражаясь более приземленно — такой дата-центр будет почти что центром однократной записи. Отчасти именно поэтому из интернета ничего нельзя удалить полностью — в ряде случаев это фактически неудобно делать, а с учетом текущих цен на растущие в объемах накопители и отсутствие наводнений с пожарами на заводах по производству HDD — вообще экономически нецелесообразно. Другим хорошим нишевым сегментом будет потоковое архивирование, например, камер наблюдения, аудиовизуальных эфиров, архивирование критических данных, которые не надо перезаписывать часто и случайно.

Минутка конспирологии

Если пофантазировать, то удобно на такой массив записать месячишко разговоров всех пользователей условного оператора мобильной связи, далее в транзитной области с помощью технологий, которые уже давно не только не секретны, а еще и обкатаны by google on youtube, например, перевести это все в txt для удобного поиска или анализа по ключевым словам и аккуратненько сложить в свободную часть массива. Исходники можно смело тереть целиком, обеспечивая FOB-запись следующего месяца. А можно и не тереть! Тогда родина будет не только слышать, знать, но и очень хорошо помнить! Доклад окончен, тов. полковник, т.е. это все, конечно же, художественный вымысел и любые совпадения с реально существующими технологиями случайны.

И зачем парнокопытным меховые музыкальные инструменты?

В итоге накопители с черепичной записью надо использовать «с поправкой на силу ветра и температуру ствола». Этим занимаются по ситуации вполне железные костыли типа HBA, которые отвечают за конкретную I/O-логику работы с таким накопителями, исполняя спецнаборы команд. В RAID такие накопители тоже можно и нужно собирать, правда, понимая специфику, но это не тема настоящего материала — главное, что вы теперь знаете немного больше вообще. Желающие могут копнуть глубже по запросу DM (самостоятельные по логике работы накопители), HA (поддержка хостом) и НМ (управляемые хостом) SMR, но столкнуться с этим SOHO-пользователю придется сильно вряд ли.

TDMR как предтеча термомагнитного будущего

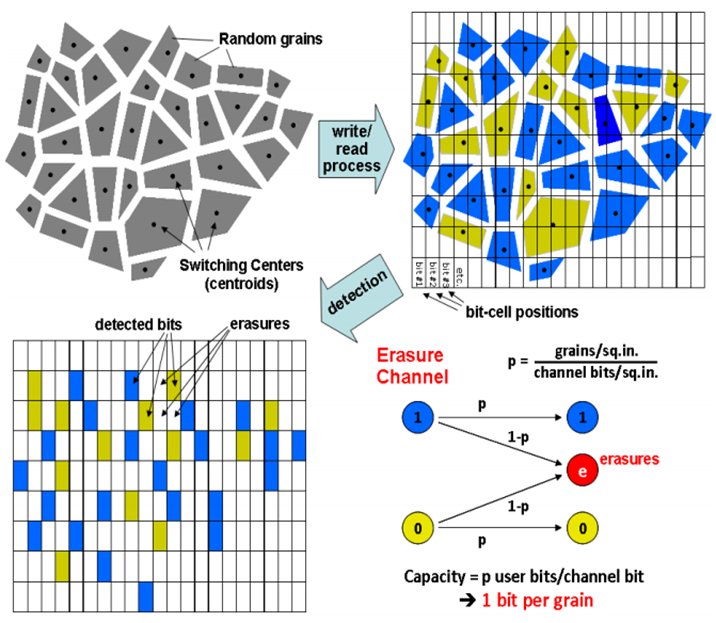

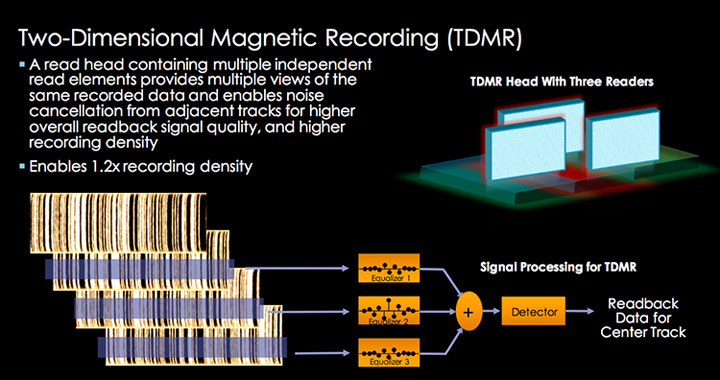

Отдельно надо упомянуть, что существует и даже начала продаваться технология TDMR — Two Dimensional Magnetic Recording в форме 14 ТБ изделий от Seagate. Здесь пытаются решать трилемму в лоб — уменьшая ширину дорожек и размеры записывающей головки. Недостижимый идеал — 1 бит на магнитное зерно. Выглядит как-то так и пояснений в Cети, что удивительно, не так уж и много.

Правда с чтением выходит фигня, которую, в свою очередь, решают головкой с несколькими читающими элементами — улучшается надежность чтения с соседних дорожек и в целом сигнал получается разборчивее. Пишущая головка продолжает быть одна. В общем итоге внедрения технологии немного растет плотность записи — процентов на 10. Но важно не это. Многоголовочное чтение пластины за проход несколькими ридерами очевидно станет мейнстримом по причине необходимости для нормального извлечения плотно записанных данных. Хороший задел, но растет сложность взаимного расположения элементов, точность их исполнения и позиционирования в работе, требуется стабильность показателей во времени.

В любом случае, именно этот этап был критически нужен перед внедрением вышеописанных тепловых инноваций, т.к. своим следствием последние будут иметь именно проблемы мелкого чтения, которые и решены превентивно в TDMR. По крайней мере, начали решаться на практике.

Очень интересно о TDMR по достаточно старой, но одной из наиболее полных по теории вопроса ссылке.

Но, возможно, скорости перспективных жестких дисков будут вопросом вторичным — об этом мы еще поговорим. Первичным будет объем и… сохранение надежности.

Моторесурс HDD и пласты залегания информации о нем

Пределы механической надежности жестких дисков можно попытаться практически изучить уже сегодня, предположив, что качество изготовления компонентов как минимум в перспективе не снизится, а новые технологии не повторят судьбу 3D и прочих рыночных фейлов. Однако спрашивать об этом производителей это как выяснять вкус меда у пчел и тонкости борьбы с коррупцией у госслужащих. Поэтому мы пойдем другой дорогой и попробуем провести что-то вроде OSINT — Open Source Intelligence, т.е. разведку проблемы по открытым источникам.

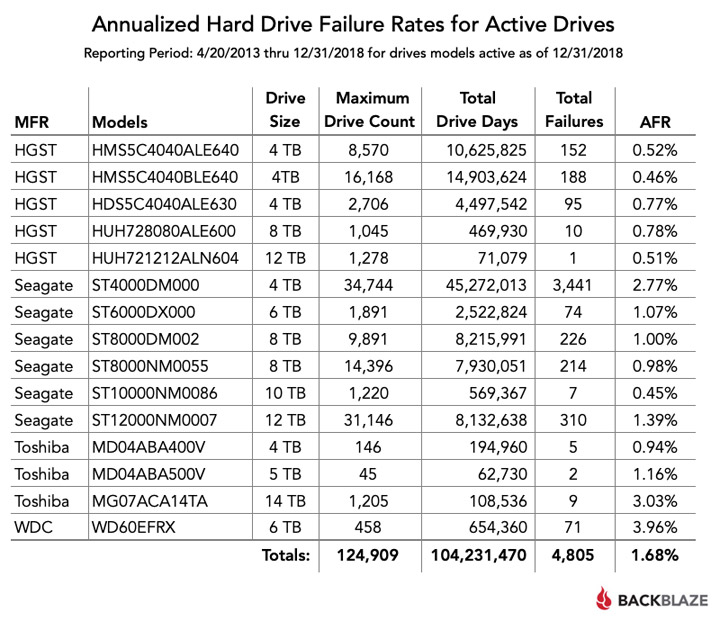

Из более-менее солидных внешне публикаций по данному вопросу можно выделить три с кусочком. Это обобщённые отчеты из Carnegie Mellon University и Google. Также навстречу нашей идее, по удачному стечению обстоятельств, движется политика публичности сетевого оператора хранения данных Backblaze.com. Компания по состоянию на 2019 год располагает почти 125 тысячами жестких дисков с пробегом почти 105 млн. диско-часов и любезно публикует статистику по надежности. Важно и то, что Backblaze.com использует в своих системах, по сути, потребительские накопители (они ощутимо дешевле), которым не положено работать круглосуточно и круглонедельно — тем интереснее статистика для изучения.

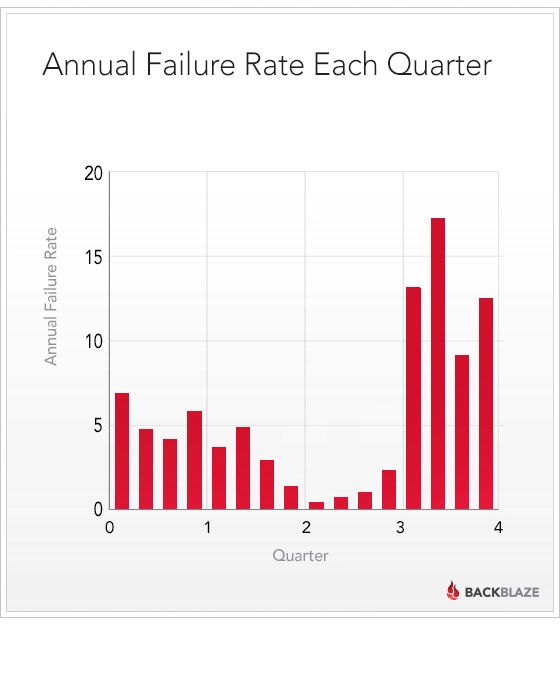

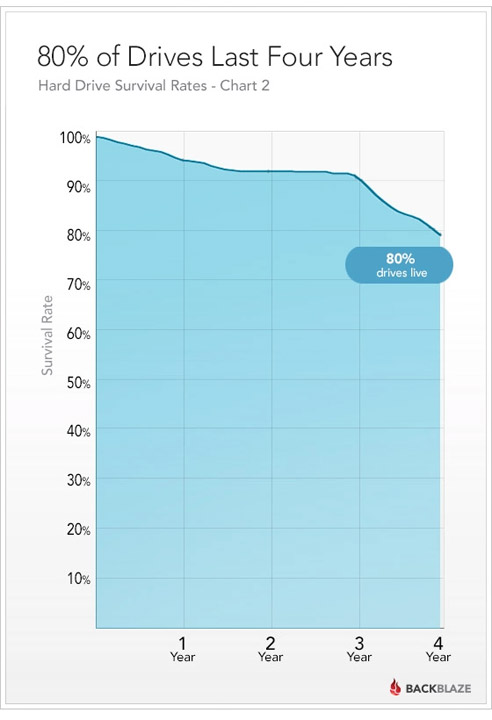

Некогда компания задалась вопросом о том, а как вообще подходить к вопросу понятия надежности жестких дисков. К 2013 году была опубликована более-менее предметная статистика по этому поводу. Если коротко, то компания отчиталась, что за 4-летний пробег основного парка из тогда еще 25 000 накопителей из строя вышло 22% дисков. 78% при этом успешно продолжали крутиться. Хорошо это или плохо? Ответ на этот вопрос займет некоторое время.

146%?

Начнем с того, что по мнению Backblaze.com 100% показатель отказов это далеко не самый плохой из возможных показателей. Считают они вот как: если сферический поставщик жестких дисков в вакууме поставит вам сотню абсолютно надежных в течение полугода накопителей, а затем они хором разово и одновременно крякнут, а вам надо чтобы они работали, то придется в течение года заменить каждый дважды. Т.е. заменить надо будет 200 дисков в год и тогда ежегодный показатель отказов составит 200%. А если каждый такой условный диск проработает всего час, то по году показатель отказов составит 876000%. «Однако!» — как говаривал К. Воробьянинов, помахав рукой преподавателям статистики.

Шторм и штиль в ванне

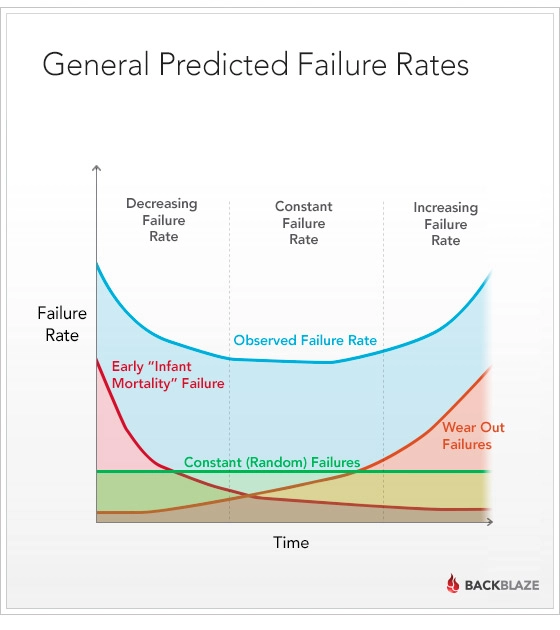

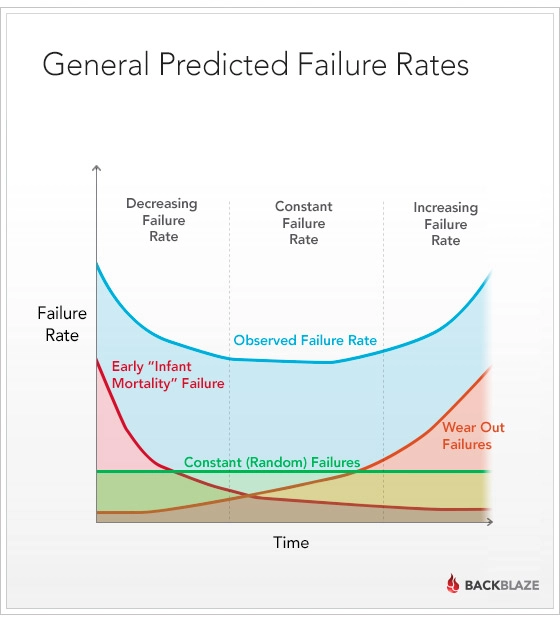

Инженеры по надежности в своей работе используют ванноподобную кривую для иллюстрации ожидаемых уровней отказов. Считается, что отказы проистекают из трех основных факторов:

- производственных дефектов, в результате которых имеет место явление, которое известно как «детские болезни» — в этом случае количество дефектов снижается;

- случайных неисправностей — величина более-менее постоянная;

- износа — количество отказов растет по понятным (кому?) причинам.

Собранные на графике «уровень отказов/время» эти факторы образуют три участка, формирующие нечто, напоминающее ванну. Отсюда и название.

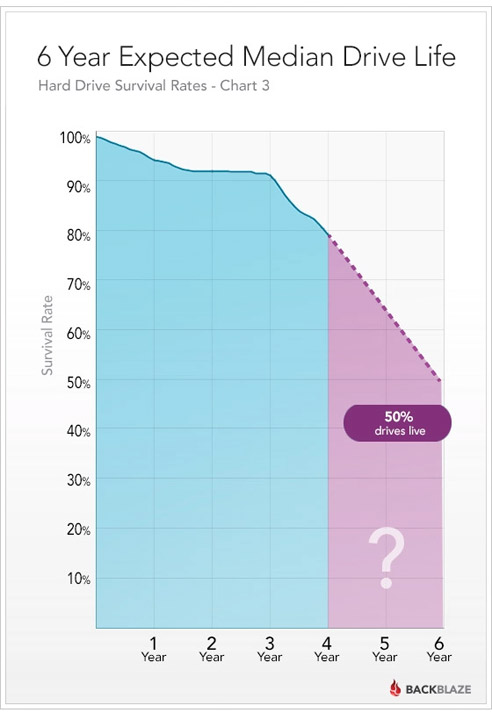

В свою очередь Backblaze.com подтверждает эту теорию цифрами, сообщая, что на 4-х летнем отрезке времени первые полтора года годовой показатель отказов колеблется в районе 5%, потом снижается на некоторое время и потом, в районе 3-летней отметки, достаточно серьезно начинает расти. Вывод — 3 года является некоей условной точкой, когда начинает сказываться износ. С износом не все однозначно, но пока мы этого не касаемся.

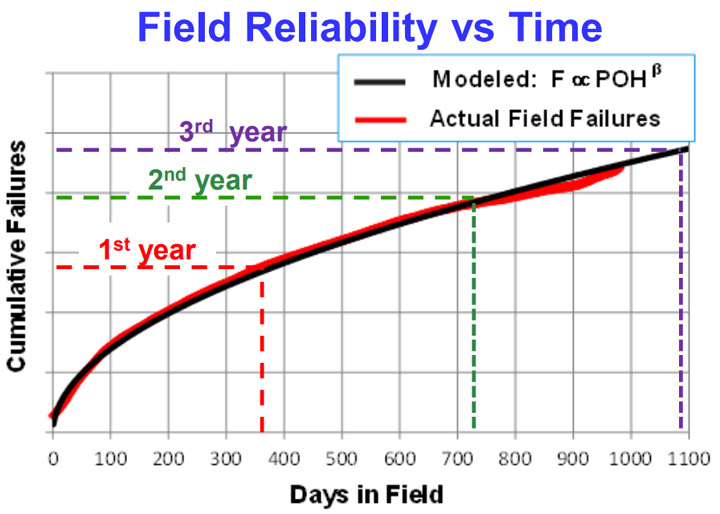

Рассмотрим график от Backblaze.com.

Бытовуха

Мы помним, что хлопцы крутят бытовые диски круглосуточно и попытаемся перевести все это в более понятные временные отрезки. Учитывая, что большинство офисно-домашних ПК работают в среднем часов по 8 в сутки, то практический срок начала существенного влияния износа на надежность для них можно условно отодвинуть к 9 годам. Почему условно? Потому как при домашне-офисной работе диски включаются-выключаются, имеют внешние воздействия в виде непостоянной температуры и т.п. Но показатель в 26000 часов работы, как некоего порога условной надежности — вполне статистически достоверный ориентир. Важно так же понять, что в данном случае к 4-му году рабочими в режиме 24/7 подошли почти 80% потребительских дисков, которые изначально в таком режиме производителем использовать и не предполагалось — для дата-центров предлагаются несколько иные решения по несколько иным же ценам. Именно поэтому мы и имеем возможность изучить статистику смелых, взявших на себя риски вложиться в бизнес на непредназначенных для этого изначально «железках».

Крякнут все?

В какой-то момент времени ожидаемо откажут все 100% накопителей, но когда это произойдет — ответить сложно и прямой статистики найти не получится, т.к. никто в сфере хранения данных в здравом уме и трезвой памяти не будет рисковать клиентскими данными ради ачивок, хотя там все и избыточно, и даже «тихим ошибкам» проскочить не суждено (Тихие — в смысле, что данные в теории могут быть записаны с ошибкой, но вскроется это только со временем. В дата-центрах это почти нереально по причине постоянных сверок контрольных сумм и коррекции ошибок, а вот в SOHO полно накопителей, которые числятся нормальными, а по факту могут быть очень не очень. Самый смак, когда на такие пишут бэкапы, которые заведомо не поднимутся, но вылезет боком это только в самый важный момент, что только добавит угара факту обнаружения).

Интересно также, что показать статистику по полным ресурсным испытаниям вплоть до полного выхода серии накопителей из строя компания не может и по объективным причинам — накопители устаревают морально быстрее. Так уже в 2015 году однотерабайтных жестких дисков в основном парке Backblaze.com не осталось, начался отказ и от 2-терабйтников. При этом для последних от тогда еще HGST оглашен кумулятивный показатель отказов в 1,55% в среднем на пятилетнем пробеге!

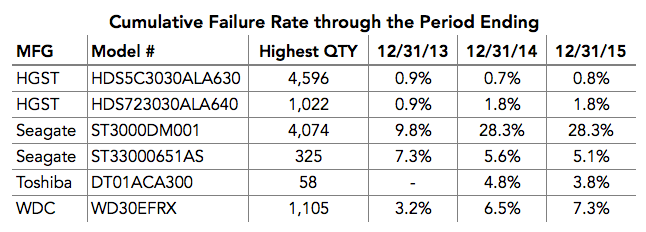

С 3-терабайтниками картина похожая, но к концу 2015-го из эксплуатации были выведены диски Seagate и приведенная статистика сильно намекает, что в модели ST3000DM001 были некоторые нюансы дизайна, материалов или сборки, т.к. кумулятивный показатель отказа по модели составил 28,3% за 2 года при максимальном количестве в парке в 4074 единицы. Увидеть бы разбор ситуации производителем. При этом HGST на большем количестве имел показатель отказов в 0,8%.

К концу 2015 года три четверти парка компании составили уже накопители на 4 TБ. Т.е. обновление парка шло достаточно быстро, пока предлагаемые рынку объемы накопителей росли.

В мире животных

Отвлекаясь немного в сторону, чтобы проиллюстрировать незримую связь бездушной техники с живой природой, отметим, что после аварии на ЧАЭС, которую героически ликвидировало население той страны под локальным руководством УС-605, где за отдельные оперативно-инженерные решения отмечены почти невиданные ранее случаи награждения одновременно внеочередными званиями и орденами (военные оценят значимость такого факта: чтобы одновременно и орден и звание) в Чернобыльской зоне де-факто сформировался природный заповедник. Изначально считалось, что живая природа, в частности фауна, на территории зоны отчуждения понесла невосполнимые утраты, но по наблюдениям через 10–15 лет оказалось, что в зоне, ввиду ее обособленности, фауна как раз наоборот — разрослась вплоть до наличия краснокнижных животных. В дальнейшем исследования показали, что хоть животные и живут в радиационно загрязнённой среде, тем не менее чувствуют себя вполне неплохо — размножаются и расширяют ареалы. Внешне складывалось впечатление, что радиация никак на них не влияет, но анализы показывали обратное. В то же время растиражированные образы ужасных чудовищ по лесам не бегали и сталкеров не кусали. Разгадка оказалась достаточно Дарвиновской — за свой естественный жизненный цикл дикие животные не успевали столкнуться с отдаленными последствиями воздействия радиации (хищная правда в том, что редкое животное в дикой природе доживает до старости и умирает по естественным причинам ввиду влияния фактора пищевых цепочек), а физически неполноценные не проходят естественный отбор в детстве. Поэтому стороннему наблюдателю кажется, что все хорошо, но на самом деле это не совсем так. Та же картина в нашем дата-центре – ввиду роста предлагаемых объемов накопителей поколения достаточно интенсивно меняются даже до наступления факторов заключительного сегмента ванноподобной кривой. Кстати, сама ванноподобная кривая, как видно из нашего отвлечения, неплохо ложится и на дикую природу с некоторым оговорками. Но вернемся к проблеме.

Мыши плакали, кололись, но продолжали есть кактус?

Поломки тоже были вполне реальной причиной вывода накопителей из эксплуатации. Антилидером рейтинга поломок оказалась опять же Seagate, но и самих дисков от них в абсолютных цифрах больше.

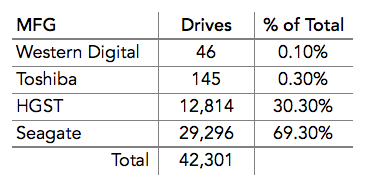

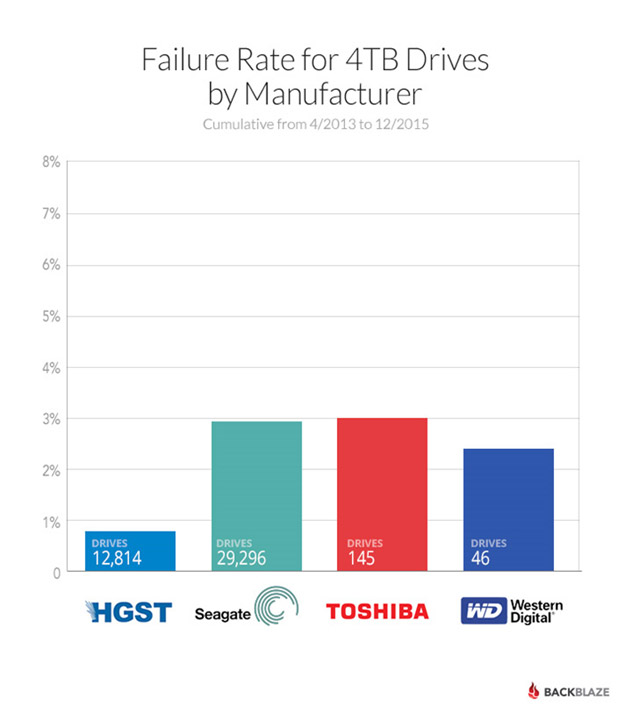

Мыши плакали, кололись, но продолжали есть кактус? Взаимоисключающие параграфы детектед? И да и нет. В Backblaze.com сообщают, что, несмотря на указанную статистику, уже в сегменте 4 ТБ накопителей уровень отказов оказался очень неплохим в среднем по больнице и выглядел так:

Продукты Seagate оказались предпочтительней по двум причинам:

- Они были дешевле. И на этом, в общем-то, можно ставить точку. Цена — главный критерий рынка. Но мы продолжим.

- Статистически достоверно было установлено, что SMART-показатели хорошо предсказывали выход устройств Seagate из строя. В общем-то, второе, возможно, даже важнее первого, т.к. предсказуемость поломок является большим плюсом в вопросе надежности в целом.

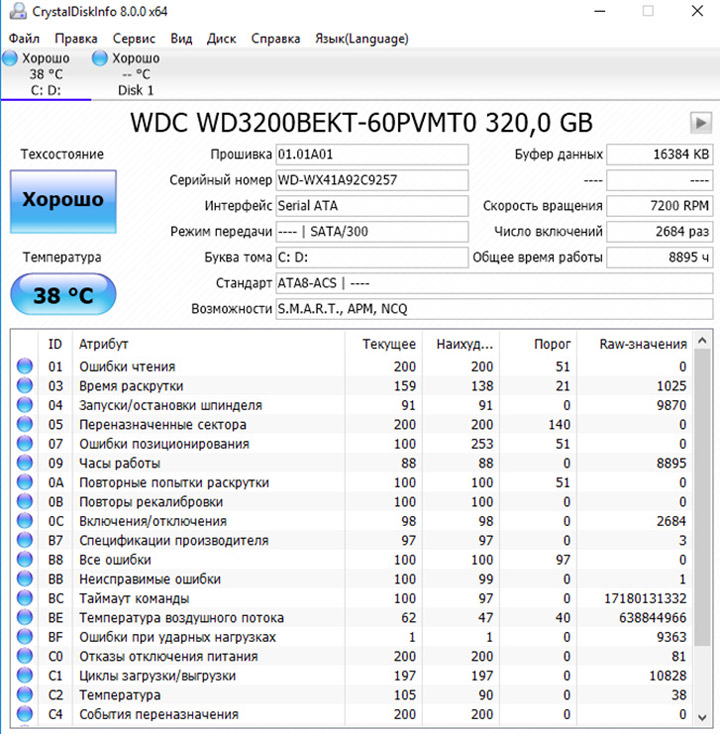

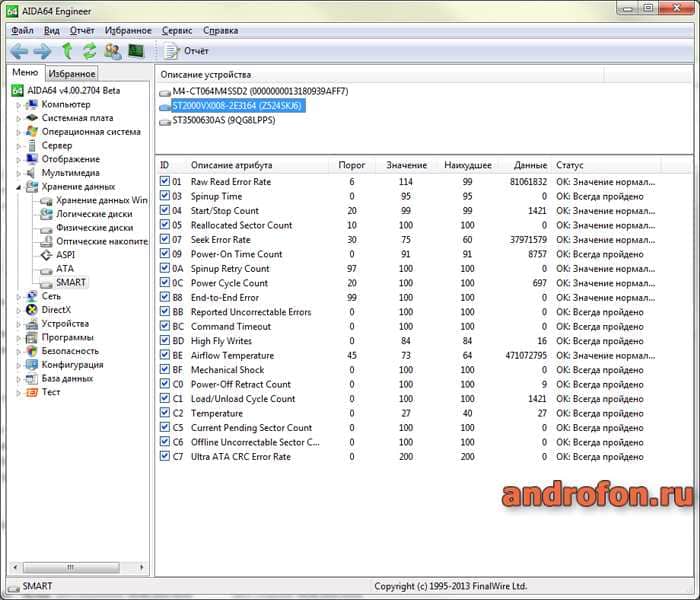

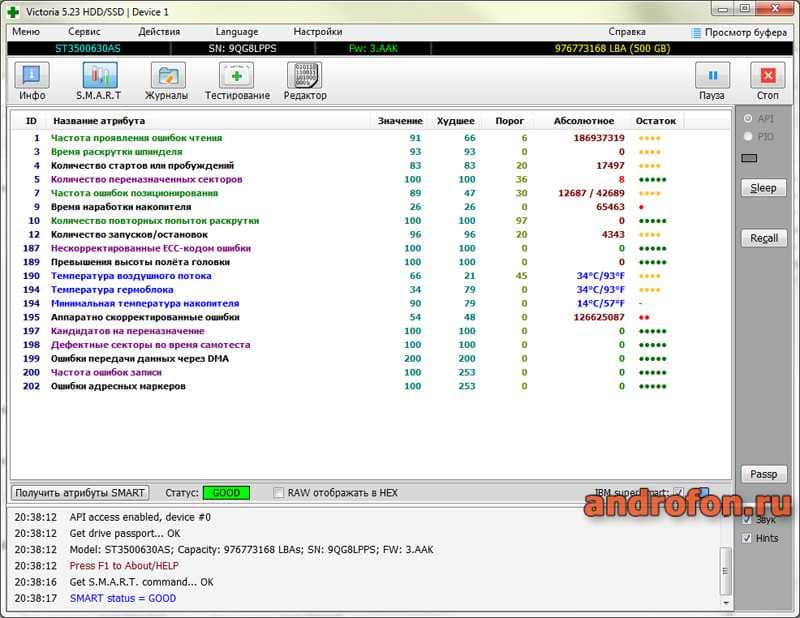

Напомним, что S.M.A.R.T. это относительно стандартизированная внутренняя система самодиагностики накопителей. Относительно, т.к. разные диски фиксируют неодинаковый набор типовых показателей в рамках этой самодиагностики, а отдельные пункты так вообще являются ноу-хау производителя, но основной их перечень более-менее стабилен и понятен. Читается разным ПО, например CrystalDiskInfo. Понимая суть этих показателей можно примерно оценить состояние накопителя. Это касается как HDD, так и SDD с учетом специфики устройства обоих.

Типичный возврат показателей S.M.A.R.T. самодиагностики программой по ссылке выглядит так, для тех, кто не в курсе.

Тут стоит заметить, что именно подразумевается под поломкой жесткого диска. Backblaze.com классифицирует эти события так:

- Накопитель не раскручивается либо не подключается к ОС.

- Накопитель не синхронизируется с RAID или отваливается от него.

- SMART намекает на проблемы.

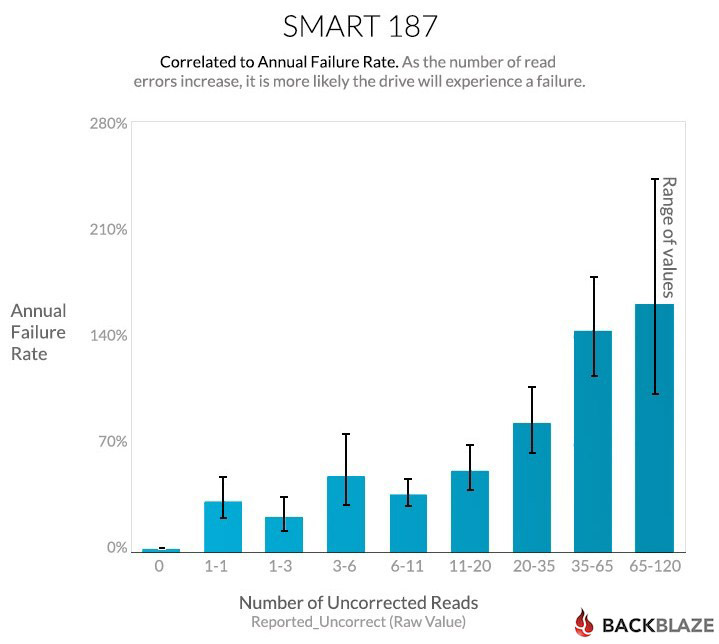

О последнем детальнее. Показателей много, но важными назначили пять:

- SMART 5 — Reallocated_Sector_Count.

- SMART 187 — Reported_Uncorrectable_Errors.

- SMART 188 — Command_Timeout.

- SMART 197 — Current_Pending_Sector_Count.

- SMART 198 — Offline_Uncorrectable.

Например, как только 187 показатель — неисправимые ошибки — сдвигается с 0, компания планирует накопитель к замене. Так же сообщается, что пока данный показатель равен 0 накопители выходят из строя крайне редко. Статистика на иллюстрации, про 280% отказов описано выше.

Т.е. прогнозируемость отказа — чуть ли не ключевое преимущество в сфере работы с данными, что, в общем-то и понятно. Мы же с вами помним, что нечто аналогичное можно проследить и в среде твердотельных накопителей, правда там отказы происходят немного внезапнее и безвозвратнее. Ну и пока дороже в финансовом плане, чем в случае жестких дисков.

Небольшое отступление для внимательных

В вышеприведенном типичном SMART-отчете вроде не видно никаких указанных мною 187,188,197,198. На самом деле видно, но в графе ID эти идентификаторы представлены в hex т.е. шестнадцатеричной системе исчисления, где помимо цифр 0, 1, 2, 3, 4, 5, 6, 7, 8, 9 используются еще и латинские буквы A, B, C, D, E, F. Т.е. для перевода цифр надо помнить, что в hex A это 10, B это 11; C это 12; D это 13; E это 14 и F это 15 в десятичном понимании, именуемом dec. Можно не париться, а поискать hex2dec конвертер или наоборот и из горы онлайн-ссылок выбрать любую. Так мы узнаем, что наш 187 показатель это шестнадцатеричное BB.

В моем типичном примере этот показатель уже отличен от 0 и равен 1, что говорит о том, что диск, в общем-то, уже не колокольчик и надо подумывать о замене всего-то на 9000 часах. Но это ноутбук и соответствующая эксплуатация — так что такое можно увидеть и на 1 часе после падения со стола. С другой стороны, в таком виде он открутит еще тысяч 20 часов и не закашляет. Не увидь я эти данные, а многие могут их не увидеть вообще никогда, то и не забивал бы себе голову. Это и есть одна из форм той самой тихой ошибки, о которой выше. Их может быть много, но с ними можно и не столкнуться. Доверять критические данные без резервного хранения таким дискам, конечно, не стоит, но по факту это делают миллионы людей ежедневно, так что иногда мониторить SMART все же имеет смысл.

He2 (т.к. просто Неlium был выше)

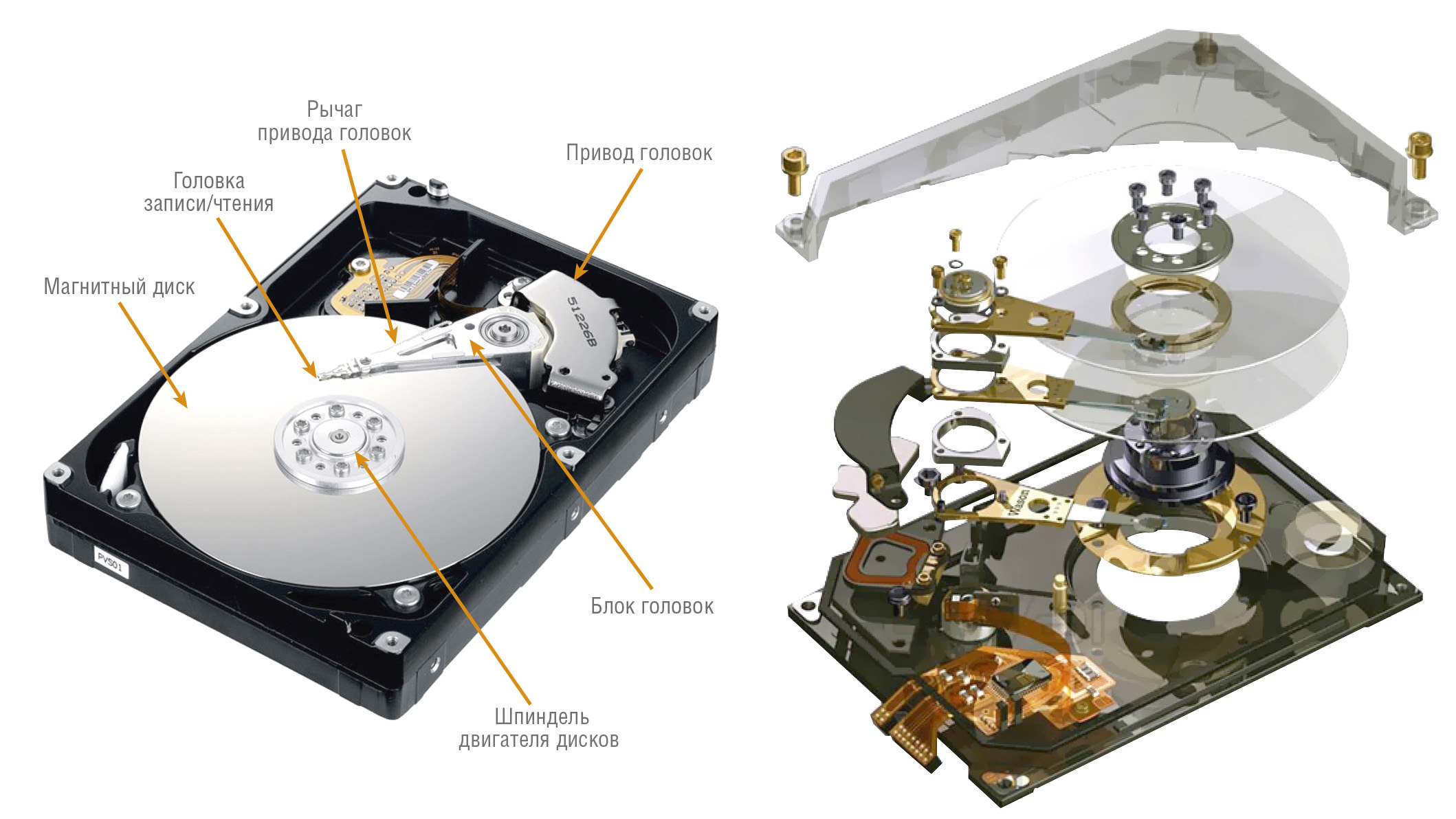

Но двинемся по статистике дальше. 4 ТБ накопители в целом оказались существенно надежнее 3 ТБ предшественников даже в рамках одного производителя. Так «трешки» от Seagate в первый год показывали 9,3% годовых отказов, а четверки — всего 2,6%.

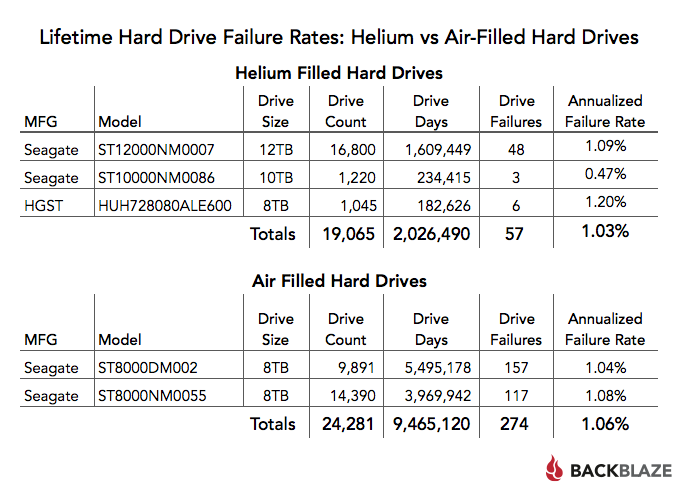

Однако объемы растут и скоро и этот парк уйдет в прошлое целиком, т.к. на марше у нас 8-ки, 10-ки и даже 12-ки! Однако здесь не все так однозначно. Дело в том, что в этом сегменте уже идет внедрение новых технологий в массовое производство. Мы помним, что воздух, состоящий в основном из азота и в потоке которого парят головки над блинами жестких дисков, сильно плотный для современных решений и физически является препятствием росту объемов и скоростей. Поэтому в новых моделях используют менее плотных гелий, т.к. газовая среда в гермоблоке необходима — в вакууме механика жесткого диска по традиционной модели работать не будет, головки в прямом смысле слова нуждаются в газовой среде. Такие себе экранопланы.

Вокруг гелия идут дискуссии. Некоторые считают, что обеспечить абсолютную герметичность внутри и исключить утечку гелия в массовых изделиях не удастся, что неминуемо приведет к отказам т.к. внутренняя механика таких накопителей заточена под менее плотную, чем воздух, среду. Теоретически это заявление, в общем-то, обосновано, но все будет зависеть от конкретных производственных возможностей по реальной герметизации массовых товарных накопителей, т.е. заявку эту можно подтвердить или опровергнуть только временем, а пока у нас есть статистика для изучения.

И эта статистика говорит, что текущие 8-терабайтники на воздухе не особо и отличаются показателем отказов от вариантов на гелии. Более того 8/10/12-терабайтники на гелии в целом показывают неплохую массовую статистику. Серия из 16800 штук на 12 ТБ от Seagate на более чем полутора миллионах диско-часов имеет годовой показатель отказа чуть более 1%. Да и вообще большие диски получились пока статистически очень неплохими.

Средняя температура по больнице

Самое время посмотреть общую статистику от Backblaze.com. Это конечно не рынок в целом, но почти 107 000 накопителей, круглосуточно работающих под нагрузкой, дают основания делать хотя бы приблизительные и статистически вроде бы относительно натягиваемые на бытового или SOHO-пользователя выводы.

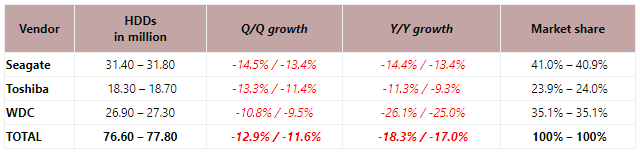

По актуальным моделям картина выглядит так:

Как видим для 45 млн. диско-дней годовой показатель отказов для 4-терабайтного Seagate составил менее 3%, т.е. при выборке из почти 35000 накопителей, которые постоянно нагружены работой, в год из строя выйдет менее 3 единиц. Примечательно, что средний пробег по этим цифрам составил примерно 3,5 года.

Промежуточные итоги

Важными выводами, которые делают из своей статистики Backblaze.com являются следующие:

- Для современных жестких дисков потребительского класса, нагруженных круглосуточно, порог роста числа отказов по износу приходится на 4 года.

- Выход из строя таких дисков — явление неплохо прогнозируемое по SMART.

- 1+2 для случая массива RAID дают хорошие гарантии того, что данные, хранящиеся таким образом на потребительских накопителях, делают это вполне надёжно при адекватном мониторинге ситуации.

Главным следствием из изложенного, вероятно, является тот факт, что в реальном SOHO с похожими нагрузками накопители встретятся нечасто, но там будут иные нюансы. Конечно, кто-то может сделать аналог домашнего дата-центра из старого сервера HP и подкинуть туда архив p2p-файлообмена, но даже в таком случае достичь нагрузок, аналогичных тем, что испытывают носители в Backblaze.com, можно будет далеко не всегда и уж точно не постоянно. В связи с этим срок полезной работы жесткого диска в домашне-офисных условиях вероятнее всего окажется больше, нежели описанные 4 года, особенно учитывая, что это только порог увеличения отказов по износу, а не момент, когда все диски выйдут из строя. Т.е. в реальности году к 5–6, если экстраполировать, где-то половина стартовавших одновременно накопителей будет жива. Но проводить эксперимент по долголетию с клиентскими данными на борту, как мы помним, никто не будет, и по показаниям SMART отклонившиеся от генеральной линии партии накопители будут заменены новыми, но к тому времени уже аппаратно иными участниками соревнований.

Some Like It Hot

К аналогичным выводам пришли ученые из Carnegie Mellon University. В частности, они отмечают, что в периоде после 5 лет эксплуатации необходимость замены носителей в крупных инсталляциях возрастает.

А вот ребята из Google установили, что влияние факторов температуры и нагрузки на выход дисков из строя несколько преувеличены и статистически заметны только для возрастных накопителей — т.е. после 5 лет, что несколько неожиданно и для них самих, т.к. ожидалось обратное.

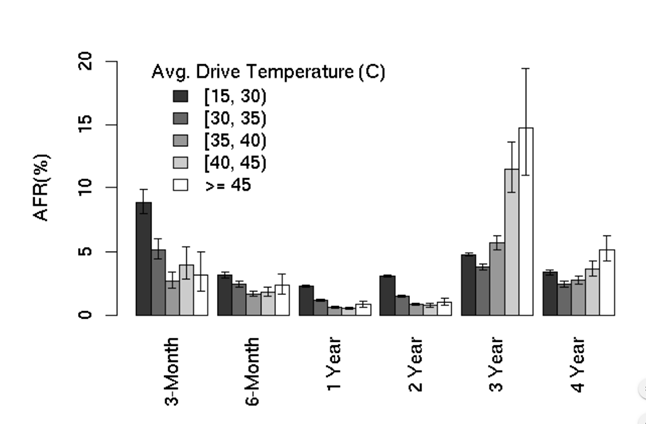

Данные в части температурного режима выглядят так — максимальные проблемы у горячих дисков на 3 году работы. А мы пока заметим, что пик пришелся на более, чем 45 градусов.

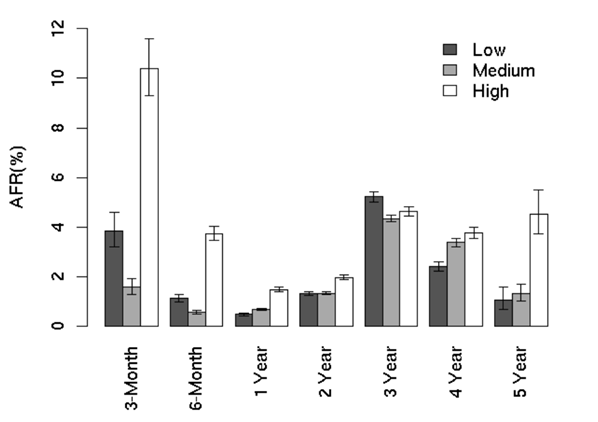

Они же сообщают, что особой разницы в случае анализа потребительских и корпоративно-профессиональных накопителей не наблюдают. Последнее, в общем-то, ожидаемо на фоне вышеизложенного. Тем не менее, для 5-летних дисков показатель выхода из строя для выборки с большой нагрузкой и маленькой отличается вдвое — около 4 и 2 %, что в абсолютном выражении не катастрофично. Для новых дисков эти показатели соответственно находятся на уровнях 10 и 4 % с некоторым разбросом, т.е. можно предположить, что под нагрузкой лучше и раньше проявляются производственно-инженерные дефекты и проблемы комплектующих.

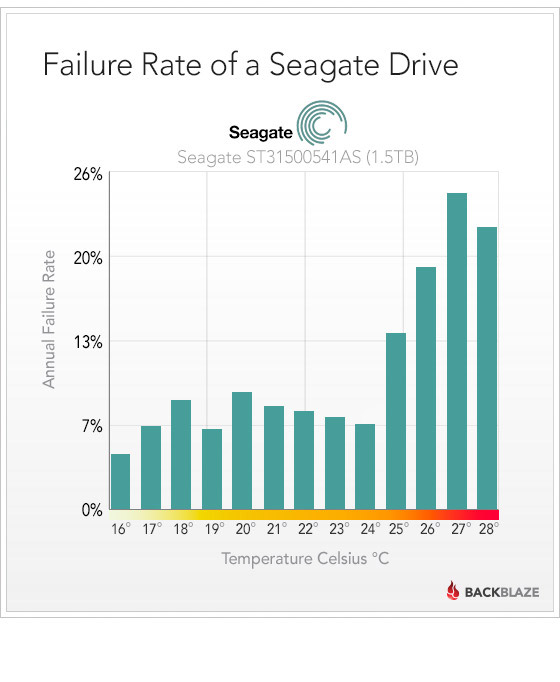

По вопросам отсутствия корреляции показателей температуры и отказов Backblaze.com в целом солидарны с предыдущим докладчиком, опираясь на статистику по 34 000 накопителям. Наличие такой связи проявляется лишь на отдельных конкретных моделях, например, Seagate ST31500541AS. Для него диаграмма выглядит так:

Для большинства же моделей жестких дисков такой связи не прослеживается. Детальнее цифры можно посмотреть по ссылке.

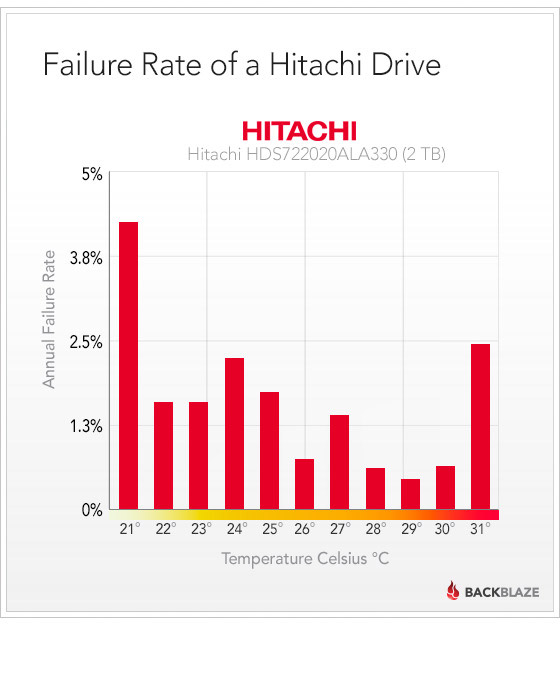

Например, по выборке Hitachi HDS722020ALA330 картина следующая и она, вероятно, обусловлена даже не столько конструктивными моментам, а конкретными условиями производства самой модели. Правда стоит отметить, что в случае с дата-центром особо нагреваться дискам никто не дает. Температурный режим и вентиляция там несравнимо получше, чем в типовом напольном мидлтауере с горой пыли внутри. Запомним этот момент, он нам еще пригодится.

И чё, и чё?

В целом три исследования практически промышленной эксплуатации жестких дисков показывают, что при постоянной нагрузке срок полезного их использования составляет примерно до 5 лет или 43800 часов. Не каждый диск в SOHO доживет до столь почтенного пробега. С другой стороны, эта статистика совершенно не значит, что не будет экземпляров, которые бы не прожили значительно дольше, например, тысяч 100. Но таковыми будут явно не все и в домашних условиях по первому чиху накопитель мало кто, в отличие от дата-центра, меняет. Поэтому отдельные «винты» даже с бэдами будут уверенно крутиться до победного, т.е. полного конца. В ряде случаев пользователи даже не будут подозревать о фактическом состоянии накопителя. Про «тихие ошибки» написано выше.

При этом важно, что производственные дефекты проявятся, скорее всего, на ранних сроках, покрываемых гарантией, после чего кондиционный диск открутит положенное.

Занимательно, но гарантия на некоторые твердотельные накопители, например, от Intel, тоже составляет 5 лет, Crucial также предлагает 5 летнюю гарантию и WD тоже. В случае с твердотельными накопителями понятие гарантии еще оперирует циклами перезаписи, но в общем случае условный пользователь имеет все шансы за 5 лет их не выработать.

В случае же обычных жестких дисков количество циклов записи-стирания условно считается неограниченным и механика деградирует заведомо раньше магнетизма (правда детально причины почему-то никто не поясняет, но пользователем достаточно этой расплывчатой формулировки — они, типа, поняли), т.е. внимание на это обращать смысла никакого нет, а вот на SMART — есть.

Что касается жестких дисков, то ожидать увеличения срока их полезного использования можно было бы, но не стоит.

Можно было бы потому, что совершенствуются технологии изготовления компонентов, разрабатываются новые материалы и технологические процессы их обработки, сборки изделий. Задавшись целью произвести надежный во времени жесткий диск реализовать такую цель технической проблемы сегодня не составляет, особенно если не гнаться за скоростями.

А не стоит, поскольку это никому среди производителей особо-то и не нужно. Ввиду взрывного роста генерации объемов данных человечеством (причем в основном бизнесом в части big data) актуальным выглядит вопрос скорее расширения объемов хранения, в т.ч. на единицу площади, а надежность можно перекрыть избыточностью и заменой накопителей в массивах — это быстрее, дешевле и проще, нежели создавать абсолютно надежный накопитель, который устареет морально быстрее, чем физически. Действительно, какой практический и массовый толк от работающего древнего накопителя на 2 ГБ сегодня? Еще и производители главного «железа» задают SOHO тон ежегодными сменами платформ, где новыми системными накопителями будут твердотельные, а бэкапы сольются в корпоративные облака, где проблемы технологий хранения клиентов на местах вообще не интересуют (по крайней мере, пока не прилетят черные лебеди в виде пары падений крупных облачных операторов)? Привет сюжету именно фильма, а не книги «Бойцовский клуб» — там есть релевантное.

Локальные же холодные данные можно хранить и на собственном жестком диске(ах) — они стоят сегодня беспрецедентно недорого и в случае RAID все вполне надежно, да и устареет по объему все скорее всего быстрее, чем износится, особенно в случае креативно-архивного использования.

В общем, производители 3–5 летнюю (WD Black для НЖМД) гарантию берут не с потолка и танцуют вокруг именно этой цифры, хотя на практике большинство накопителей в домашних и околопрофессиональных условиях ее перешагнет. Почему положение дел именно такое — пояснено выше: на подходе новые технологии и повышать выносливость старых никто не будет, а вот что покажут инновации — увидим уже совсем скоро.

В любом случае списывать со счетов даже текущие технологически диски еще рано и об этом наш следующий материал.

Но, one more thing, как говорят любители фруктов

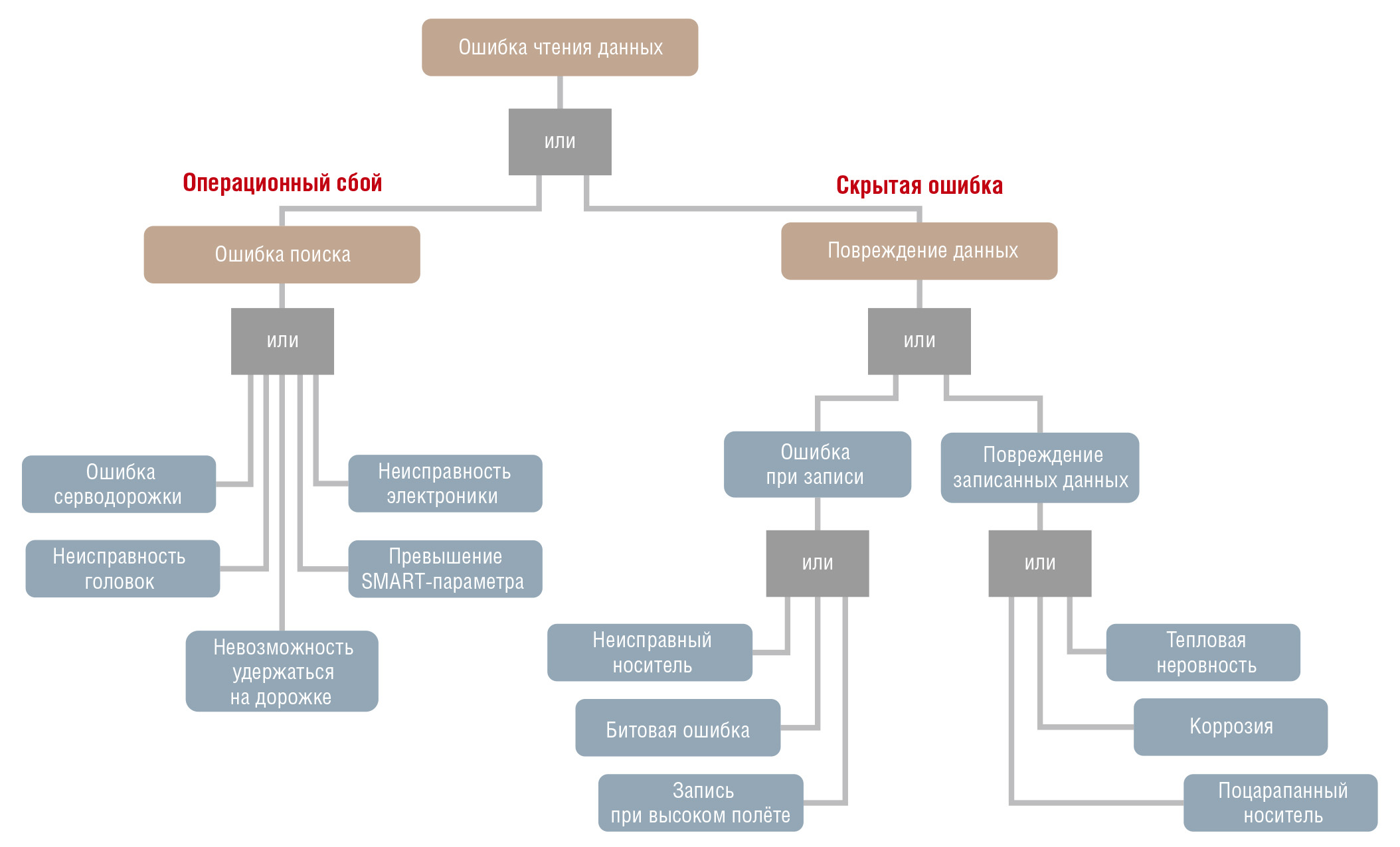

Внимательный читатель уже задается вопросом — где же технические первопричины описанного, Билли? Не втирают ли нам какую-то дичь? Так много слов о ресурсе, износе и прочем, а по факту никакого технического матана! Что же изнашивается? Как это происходит?

Их есть (с), но придется несколько расширить рамки публикации. Данные опять же из открытых источников — у нас же OSINT! И в этот раз мы смотрим на точку зрения одного из трех оставшихся китов, на которых стоит рынок HDD — WD.

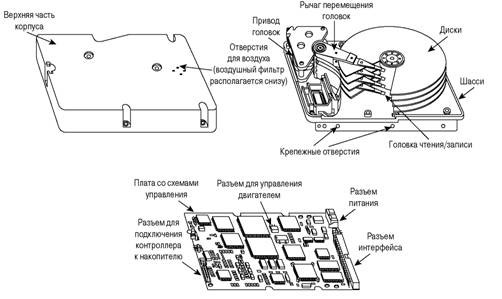

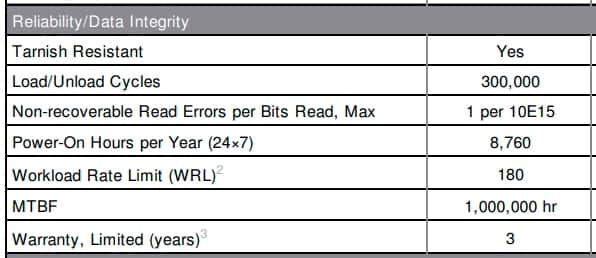

Коротко вспомним, что такое жесткий диск — это устройство хранения данных, основанное на магнетизме. В литой и фрезерованный корпус (шасси) помещается сборка рабочих твердых магнитных дисков, которые крутит электромотор. Над и между пластинами бегают пишущие и читающие головки на длинных коромыслах, чтобы охватить весь радиус блина. Рабочее пространство закрывается крышкой — там «чистое» в плане пыли пространство. Есть еще плата управления, шлейфы и разъем интерфейса снаружи. На плате будет электроника в виде контроллера, DRAM-буфера и т.п.

На картинке негерметичный пример. Для герметичного в случае, например, гелия принципиальнее отличия конструкции только в газообмене ну и тонкости элементов.

Итак — самый жир

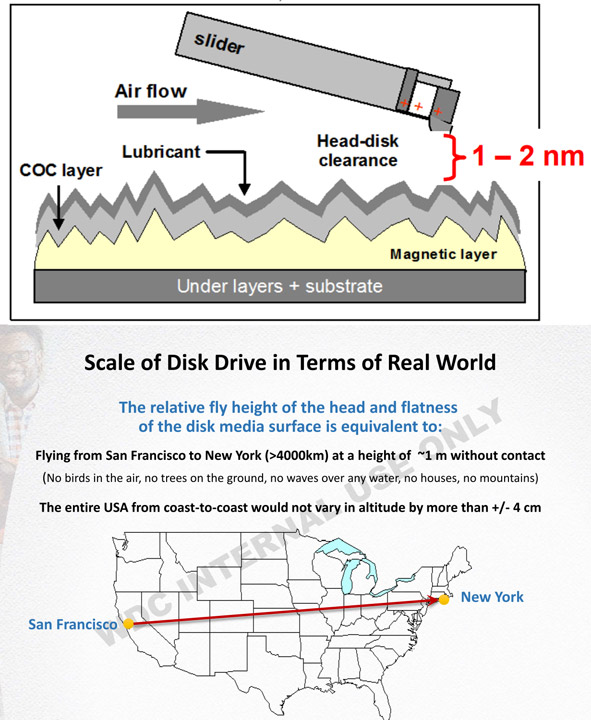

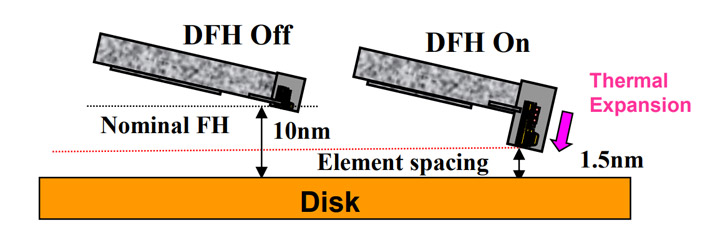

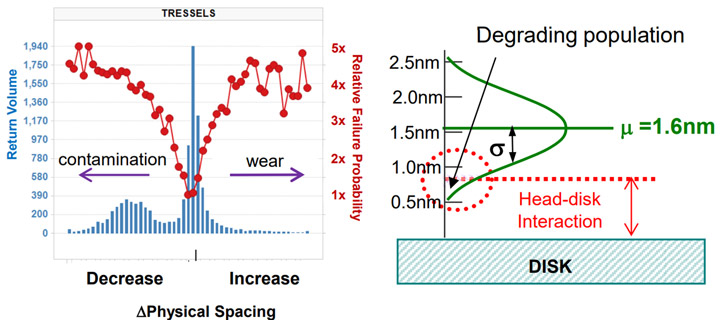

WD нам сообщает, что около 70% всех проблем жестких дисков — это проблемы зазора головок и блинов. При его нарушении происходит контакт с неблагоприятными последствиями.

Сегодняшние зазоры — менее 2 нанометров! И секретный инсайд из WD постулирует, что, экстраполируя это на реальным мир, мы получим полет на самолете через все США на высоте 1 м с неравномерностью территории +/– 4 см. Не впилиться бы в секвойю, но их в нашем макроаналоге не предусмотрено. Именно поэтому жесткие диски боятся ударов.

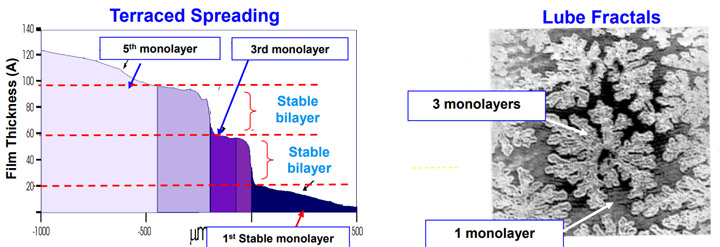

Ботающие на английском увидели слово lubricant. Оказывается (и я гарантирую, что многие не знали), на блине жесткого диска есть монослой смазки для снижения адгезии и трения между головками и диском. Поднятие лубриканта слайдером — явление целиком нормальное в своих масштабах, но «глубоко» копать категорически нельзя, ибо будут в прямом смысле запилы рабочей поверхности.

Дело в том, что физические характеристики мономолекулярных пленок зависят от фактического количества материала и последствия копки могут быть отложенными.

Помните про магию и самоуспокоение — теперь по ходу материала вы начинаете знать еще немного больше.

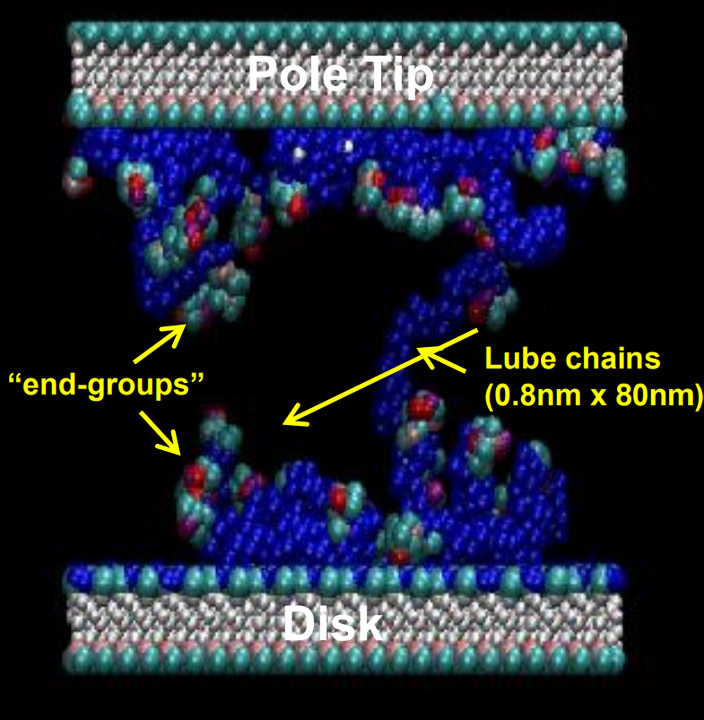

Но мы продолжим. На головках и блинах используется покрытие из алмазоподобного углерода (химики намекают, что алмаз и есть углерод, но алмаз — форма, обуславливающая эксплуатационные характеристики). Сегодняшние толщины покрытий — чуть ли не менее нанометров. В случае утончения начинается рост рисков запилов, износа и даже миграции (!) магнитного материала. Если копать дальше, то мы уйдем в трибологию, что, в общем-то, очевидно. О трибологических аспектах в контексте головок и блинов жестких дисков почитать можно по ссылке.

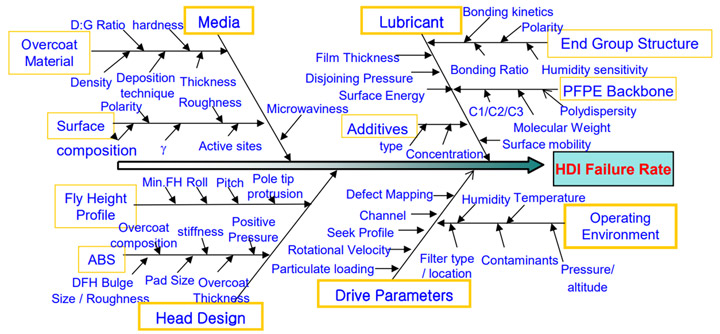

В общем, тема поддержания достаточного просвета пары пластина-головки является чуть ли не главной в вопросах надежности современных жестких дисков. Множество факторов, на нее влияющих приведено на иллюстрации ниже:

HDI расшифровывается как HEAD-DISK INTERACTION.

Правда красиво? Все это иллюстрирует тезис о том, что новые поколения жестких дисков, ввиду усложнения, будут подвержены новым, возможно неизвестным сегодня, рискам. Инженерам действительно непросто — рынок требует бОльших объемов дата-центров. И объемы по вменяемым ценам сегодня могут дать только старые (старые ли уже?) добрые (точно не злые) жесткие (об этом в первой части) диски (внешне, правда, прямоугольные). Важно понимать, что вопросы надежности являются объектом процесса моделирования на стадии разработки и модели эти эволюционируют вместе с индустрией — иного выхода нет, иначе рынок покажет производителю филейную часть. Поэтому же в ванноподобной кривой из начала материала всегда будет первый сегмент, ответственный за т.н. «детские болезни».

О ванной за пределами IT

Первый сегмент формируется косяками в вопросах качества, материалов, ошибками инжиниринга (привет некоторым моторам группы VAG и BMW, например), а также проблемами самого производства как процесса.

Немного окинем взором мировые мемы по теме. Вначале 2000-х потребители продукции АвтоВАЗа столкнулись с проблемой вибрации руля на скорости 110 км/ч. Проблема не решалась — лучшие балансировочные станки выводили колеса в идеальный баланс, но в руль все равно било. В итоге население экспериментально установило, что если, внимание, отбалансировать колесо прямо на ступице, то проблема исчезала. Называлось это финишной балансировокой и стоило дорого, при смене колеса делать приходилось заново. Письма производителю ожидаемо не дали никакого результата, и народ вошел в исследовательскую фазу. А ларчик открывался просто — на конвейер закупили колесные диски, где диаметр центрального отверстия на 1,5 мм был больше посадочного места на ступице. На шиномонтажах колесо прикручивали со смещением, что и вызывало биение в руль идеально отбалансированного колеса. По этой же причине балансировка на ступице проблему решала, но прошли месяцы и чуть ли не годы, пока производитель прокрастинировал, а народ ломал головы. Проблему, кстати, решили сами пользователи, а не завод. Мучения c ранним двухдисковым сцеплением от VAG и радости владельцев 5-литровых V8 от BMW, употребляющих масло ведрами, вначале 2000-х — тема отдельная. Так что не только Аpple умеет накосячить с антенной, кнопками, экранами и держать покерфейс, а тут — какие-то копеечные диски.

По этим же причинам у кривой есть замыкающая часть (хотел написать — последняя, но вдруг нас читают парашютисты, КВСы, штурманы дальнего хождения и иже с ними) и, как мы слегка подсмотрели, там есть чему изнашиваться кроме мотора. Поэтому наступление периода критического роста вероятностей выхода носителя из строя называется так не случайно — в этом периоде важные накопители лучше таки менять на исправные.

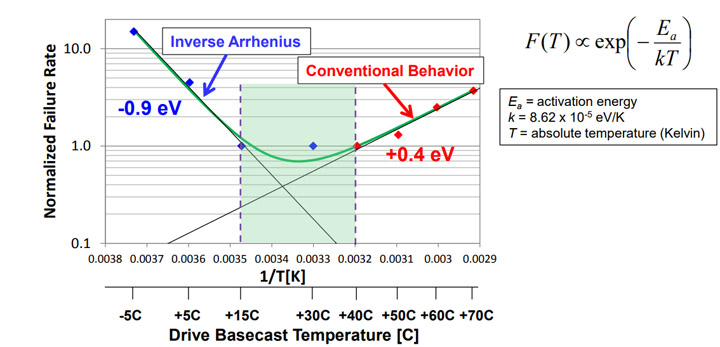

Матан производителей, в отличие от приведенных выше данных, говорит о том, что время — самый плохой доктор для жестких дисков. Картинка чуть ли не из второго закона термодинамики — энтропия, т.е. процент отказов возрастает.

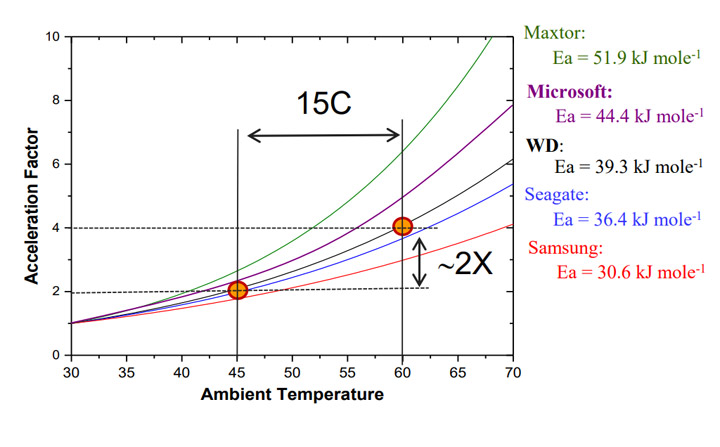

А вот следующим фактором вылета «винтов» производители считают… температуру.

BSOD WTFаками и его разрешение

Самое время читателям предъявить мне:

Да как так-то ? (с) Вверху же совсем обратное!

Амбивалентность ситуации разрешить было непросто, но я смог.

Графики надо читать и анализировать!

Смотрим внимательно слайды. Раз.

И два.

Если коротко, то вышеподписавшиеся охватывали вниманием иные температурные диапазоны, где влияние температуры особо-то и не проявляется. Дата-центры — не сауны с блекджеком и там с кондиционированием все в порядке.

Зато вывод WD сотоварищи постулирует о том, что вероятность отказов возрастает вдове на каждые 15 градусов Цельсия роста температуры. Заметим — это не исключает мнение предыдущих ораторов. Градусов с 50-ти начинается серьезный рост перспективы вылета накопителя. Именно перспективы, а не самих вылетов. Но почему?